TurboQuant: Online Vector Quantization with Near-optimal Distortion Rate

https://arxiv.org/abs/2504.19874

Amir Zandieh, Majid Daliri, Majid Hadian, Vahab Mirrokni | Google Research, New York University, Google DeepMind | arXiv:2504.19874 | 2025년 4월

1. 서론: LLM 추론 병목을 겨냥한 온라인 벡터 양자화의 재정의

최근 대규모 언어 모델의 실제 운영 비용은 파라미터 수 자체보다도 메모리 이동과 컨텍스트 길이에서 비롯되는 경우가 많다. 특히 긴 문맥 추론에서는 KV 캐시가 레이어 수, 헤드 수, 시퀀스 길이에 비례해 빠르게 불어나며, 이로 인해 HBM과 SRAM 사이의 병목이 실질적인 처리량을 제한한다. 이 논문은 바로 이 지점에서 출발한다. 논문은 단순히 "양자화를 더 세게 하자"고 주장하지 않고, 벡터 양자화를 정보이론적 관점에서 다시 정식화하여, 평균제곱오차와 내적 보존이라는 두 목표를 동시에 엄밀하게 다루는 새로운 프레임워크를 제안한다.

TurboQuant의 흥미로운 점은 오늘날 LLM 서빙에서 자주 쓰이는 많은 양자화 기법과 달리, 입력 데이터셋에 맞춘 복잡한 보정(calibration)이나 오프라인 학습 절차를 전제하지 않는다는 데 있다. 논문은 이를 online, 혹은 data-oblivious한 벡터 양자화라고 부른다. 다시 말해, 새로운 데이터가 실시간으로 유입되거나 벡터 데이터베이스가 지속적으로 갱신되는 환경에서도 바로 적용 가능한 구조를 지향한다. 이는 정적 벤치마크에서만 강한 방법이 아니라, 실제 서비스 환경에서 지연과 비용을 줄이는 데 직접 연결될 수 있다는 뜻이다.

논문이 겨냥하는 핵심 문제는 두 가지다. 첫째는 복원된 벡터가 원래 벡터와 얼마나 가까운지를 측정하는 평균제곱오차(MSE) 최소화이다. 둘째는 검색, 어텐션, 최근접 이웃 탐색처럼 벡터 간 내적이 본질적인 연산에서, 양자화 이후에도 내적 구조가 얼마나 잘 유지되는가이다. 전자는 압축 후 재구성 품질을, 후자는 실제 다운스트림 연산의 정확도를 반영한다. 논문은 기존 기법들이 이 두 목표를 동시에 만족시키지 못하거나, 특히 내적 추정에서 편향을 만들어낸다는 점을 비판적으로 짚는다.

TurboQuant의 핵심 아이디어는 놀라울 정도로 직관적이면서도 수학적으로 정교하다. 입력 벡터를 무작위 회전시켜 좌표 분포를 고차원 구면 상의 거의 독립적인 분포로 바꾸고, 이후 각 좌표에 대해 최적 스칼라 양자화기를 적용한다는 것이다. 표면적으로 보면 "벡터 문제를 좌표별 문제로 단순화"한 것처럼 보이지만, 논문은 이 단순화가 고차원에서 왜 정당화되는지를 베타 분포, 정규 근사, 샤논 하한, Yao의 minimax 원리 등을 통해 정식으로 증명한다. 요컨대 이 논문은 구현적으로는 단순하지만 이론적으로는 매우 강한 보장을 가진 희귀한 유형의 연구에 속한다.

또 하나 주목할 부분은 논문이 단순한 이론 논문에 머물지 않는다는 점이다. 저자들은 Needle-In-A-Haystack 테스트, LongBench, 그리고 최근접 이웃 검색 실험을 통해 TurboQuant가 실제 LLM KV 캐시 압축과 검색 워크로드에서 얼마나 실용적인지 보여준다. 특히 3.5비트 채널당 설정에서 사실상 풀프리시전과 동일한 LongBench 평균 점수를 기록하고, 2.5비트에서도 품질 저하를 비교적 작게 억제한 결과는 이론적 왜곡률 보장이 실제 엔드투엔드 품질로 이어질 수 있음을 강하게 시사한다.

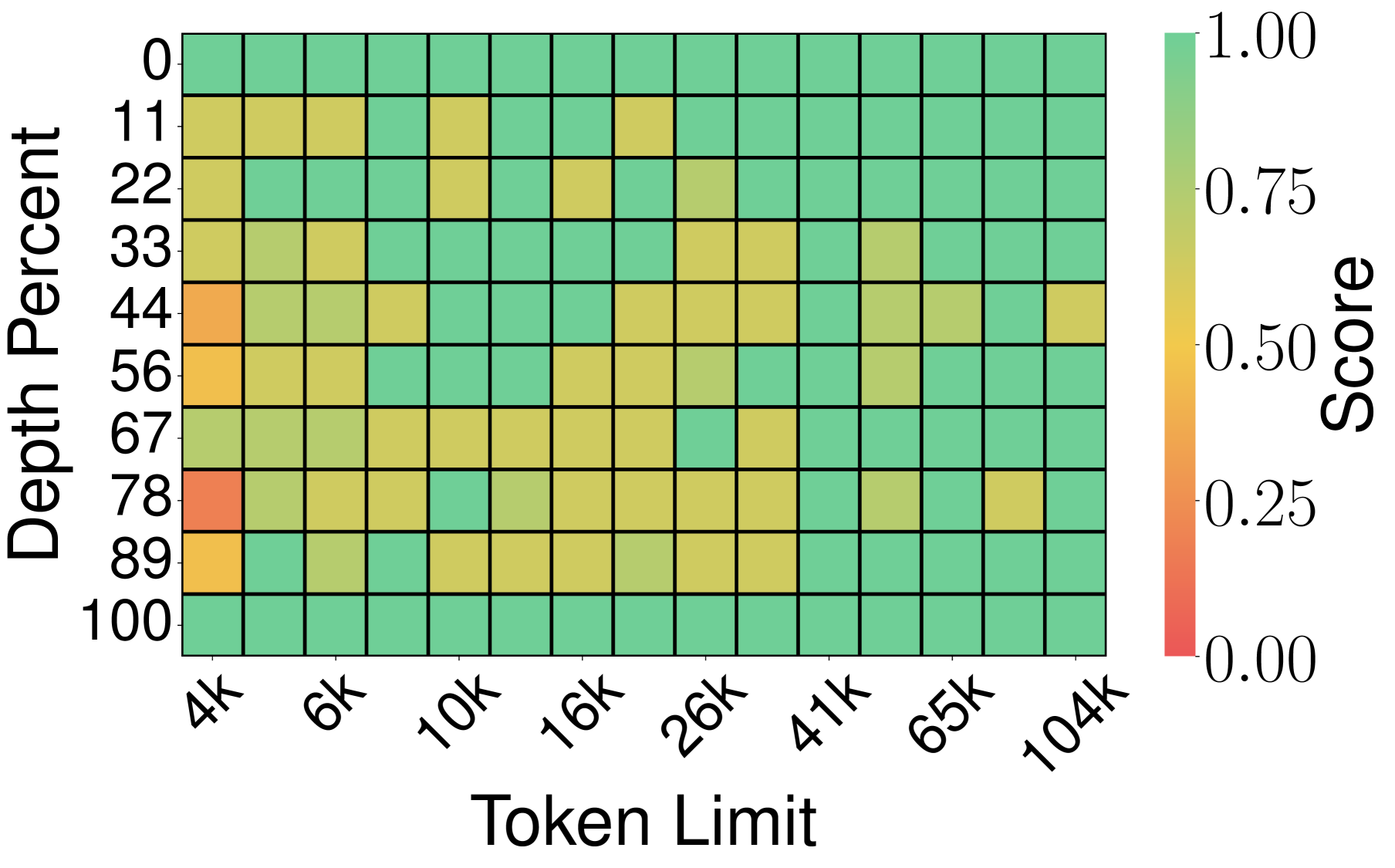

Figure 1: Llama-3.1-8B-Instruct 기반 Needle-In-A-Haystack 테스트 결과. TurboQuant는 4배 이상 압축된 상태에서도 풀프리시전과 동일한 0.997 점수를 기록한다.

이 리뷰에서는 논문이 제시한 문제 정의, 관련 연구 맥락, 핵심 알고리즘, 정보이론적 하한, 그리고 LLM 및 벡터 검색 벤치마크에서의 실험 결과를 순서대로 정리한다. 특히 왜 무작위 회전이 핵심인지, 왜 MSE 최적 양자화기만으로는 내적 보존이 충분하지 않은지, 그리고 왜 저자들이 잔차에 대해 QJL을 추가한 2단계 구조를 설계했는지를 집중적으로 해설한다. 논문은 양자화 연구를 "얼마나 작게 줄일 수 있는가"에서 "어떤 연산 구조를 보존해야 실제로 유용한가"라는 더 본질적인 질문으로 이동시키며, 그 과정에서 매우 설득력 있는 해답을 제시한다.

- 고차원 벡터를 무작위 회전해 좌표별 거의 독립적인 분포로 만든 뒤, 좌표별 최적 스칼라 양자화를 수행한다.

- TurboQuantmse는 MSE 최소화에 초점을 맞추고, TurboQuantprod는 내적 추정의 무편향성을 목표로 한다.

- 샤논 하한과 minimax 원리를 이용해 정보이론적 하한에 상수배 수준으로 근접함을 증명한다.

- KV 캐시 압축과 최근접 이웃 탐색에서 모두 경쟁력 있는 결과를 보이며, 특히 온라인 적용 가능성이 높다.

2. 배경 및 관련 연구: 왜 기존 양자화로는 충분하지 않았는가

2.1 문제 정의와 평가 기준: MSE와 내적 오차를 함께 봐야 하는 이유

논문은 먼저 벡터 양자화를 매우 명시적인 수학적 문제로 정의한다. 차원 $d$의 실수 벡터를 총 $B$비트의 이진 표현으로 보내는 양자화 맵 $Q: \mathbb{R}^d \rightarrow \{0,1\}^B$와, 이를 다시 실수 공간으로 되돌리는 복원 맵 $Q^{-1}: \{0,1\}^B \rightarrow \mathbb{R}^d$를 설계하는 것이 기본 설정이다. 여기서 $B = b \cdot d$이면 좌표당 평균 비트 수가 $b$가 된다. 이 정의는 평범해 보이지만, 논문은 여기서부터 이미 중요한 구분을 도입한다. 단순한 압축률이 아니라, 압축 후 어떤 기하학적 성질이 얼마나 보존되는지를 정확히 측정해야 한다는 것이다.

첫 번째 목적 함수는 MSE 왜곡이다. 이는 원래 벡터 $x$와 복원 벡터 $Q^{-1}(Q(x))$ 사이의 유클리드 거리 제곱의 기댓값으로 정의된다. 수식으로 쓰면 다음과 같다.

$$D_{\mathrm{mse}} := \mathbb{E}_Q \left[\|x - Q^{-1}(Q(x))\|_2^2\right].$$

두 번째 목적 함수는 내적 오차이다. 이는 임의의 질의 벡터 $y$에 대해 원래 내적 $\langle y, x \rangle$와 양자화 후 복원 벡터와의 내적 $\langle y, Q^{-1}(Q(x)) \rangle$ 사이 차이의 제곱 기댓값으로 주어진다. 논문은 이를 다음처럼 정의한다.

$$D_{\mathrm{prod}} := \mathbb{E}_Q \left[(\langle y, x \rangle - \langle y, Q^{-1}(Q(x)) \rangle)^2\right].$$

이 두 기준은 실제 응용에서 서로 다른 의미를 가진다. 모델 가중치나 활성값을 복원해서 다시 쓰는 상황에서는 MSE가 중요해 보일 수 있지만, 어텐션 연산, 검색 점수 계산, 벡터 DB 같은 환경에서는 사실상 내적 구조가 더 직접적인 성능 지표다. 복원된 벡터가 원래 벡터와 가까워도, 내적이 체계적으로 치우치면 검색 순위나 어텐션 스코어가 왜곡될 수 있다. 논문은 바로 이 지점을 지적하면서, 기존 양자화 연구가 MSE만 지나치게 중시하거나 반대로 특정 태스크에 맞춰 경험적으로 조정되는 경향이 있었다고 서술한다.

특히 논문은 내적 양자화기에는 무편향성이 바람직하다고 본다. 즉,

$$\mathbb{E}_Q[\langle y, Q^{-1}(Q(x)) \rangle] = \langle y, x \rangle$$

가 성립해야 한다는 것이다. 이는 한 번의 양자화 결과가 약간의 잡음을 포함하더라도, 평균적으로는 내적을 체계적으로 과대평가하거나 과소평가하지 않아야 함을 의미한다. 검색이나 어텐션처럼 순위 기반 연산에서는 이런 무편향성이 특히 중요하다. 논문은 이후 실험에서 MSE 최적화 양자화기는 저비트 환경에서 내적 편향을 만든다는 점을 강조하며, TurboQuantprod를 따로 설계한 이유를 여기에 둔다.

| 평가 대상 | 정의 | 실무적 의미 |

|---|---|---|

| MSE 왜곡 | $\mathbb{E}[\|x-Q^{-1}(Q(x))\|_2^2]$ | 복원 벡터가 원래 벡터의 기하 구조를 얼마나 잘 유지하는지 측정 |

| 내적 오차 | $\mathbb{E}[(\langle y,x\rangle-\langle y,Q^{-1}(Q(x))\rangle)^2]$ | 검색, 어텐션, 최근접 이웃 탐색 등 내적 기반 연산의 품질을 직접 반영 |

| 무편향 조건 | $\mathbb{E}[\langle y,Q^{-1}(Q(x))\rangle]=\langle y,x\rangle$ | 평균적으로 점수 체계가 한쪽 방향으로 치우치지 않음을 보장 |

2.2 기존 연구의 한계: 오프라인 적응, 스칼라 양자화, 이론 부재

관련 연구 맥락에서 논문은 벡터 양자화의 역사가 샤논의 손실 압축 이론으로 거슬러 올라간다고 설명한다. 이후 Zador, Gersho 등의 고해상도 이론은 왜곡률 함수의 구조를 해명했지만, 실제 온라인 시스템에서 바로 쓸 수 있는 구현 가능한 알고리즘을 제공하지는 못했다. 반면 현대 딥러닝에서는 PQ, GPTQ, Quarot, KIVI, PolarQuant 같은 매우 다양한 양자화 기법들이 등장했지만, 이들 중 상당수는 특정 데이터셋에 맞춘 보정, 헤시안 정보 활용, 채널별 교정, 혹은 오프라인 학습을 필요로 한다. 논문은 이런 방법들이 정적 모델 배포에는 유용할 수 있어도, 동적 데이터 유입이나 온라인 검색 시스템 같은 환경에는 적합하지 않을 수 있다고 지적한다.

특히 KV 캐시 압축 영역에서는 토큰 프루닝 계열과 스칼라 양자화 계열이 대표적이다. SnapKV나 PyramidKV는 토큰 차원에서 정보를 줄이는 방식이고, KIVI는 채널 단위의 양자화를 통해 메모리 절감을 시도한다. 그러나 논문은 이런 기법들이 특정 구조나 휴리스틱에는 강할 수 있어도, 왜곡률에 대한 강한 이론적 보장이 부족하다고 본다. TurboQuant는 이 점에서 차별화된다. 저자들은 단순히 성능이 좋다는 실험 결과를 제시하는 데 그치지 않고, 어떤 비트폭에서 어느 정도의 왜곡이 불가피한지에 대한 하한까지 제시한다.

또 다른 중요한 비교축은 온라인 대 오프라인이다. 논문은 온라인 방법을 데이터 비의존적(data-oblivious)으로 정의한다. 이런 방법은 새 벡터가 들어오는 즉시 즉석에서 압축할 수 있고, 데이터셋 전역의 통계량을 다시 계산하거나 코드북을 재학습할 필요가 없다. 반대로 오프라인 방법은 특정 데이터 분포를 학습해 양자화 맵을 맞춤형으로 설계하므로, 분포가 바뀌면 다시 학습하거나 보정해야 한다. 벡터 데이터베이스나 실시간 LLM 추론 환경에서는 후자의 비용이 상당할 수 있다.

논문이 내세우는 TurboQuant의 강점은 바로 여기서 나온다. 입력 벡터 자체의 분포를 학습하는 대신, 무작위 회전을 통해 분포를 설계 가능한 형태로 바꾸고, 그 위에서 좌표별 최적 양자화기를 적용한다. 다시 말해 분포 적응을 데이터셋에서 배우는 대신, 수학적으로 통제 가능한 변환으로 대체하는 것이다. 이 접근은 구현을 단순화할 뿐 아니라, 이론적 분석을 가능하게 해준다. 저자들은 이러한 특성이 장기적으로는 LLM 서빙과 검색 인프라에 더 적합한 방향이라고 암묵적으로 주장한다.

- 오프라인 적응형 기법: 데이터 분포에 맞춰 성능을 높일 수 있지만, 새로운 데이터 유입 시 재보정 비용이 크다.

- 스칼라 양자화 계열: 구현은 단순하지만 고차원 벡터 구조를 충분히 활용하지 못해 왜곡률이 나빠질 수 있다.

- 토큰 프루닝 계열: 특정 맥락에서는 효과적이지만, 정보 손실 메커니즘을 일반적인 왜곡률 언어로 비교하기 어렵다.

- TurboQuant: 온라인 적용성, 계산 효율성, 정보이론적 분석 가능성을 동시에 노린다.

2.3 이론적 배경: 구면 분포, 샤논 하한, 그리고 왜 고차원이 유리한가

TurboQuant가 성립하려면 왜 무작위 회전이 유효한지 이해해야 한다. 논문은 단위 구면 $S^{d-1}$ 위의 임의 점을 생각했을 때, 각 좌표가 특정한 베타 분포를 따르고 차원이 커질수록 정규분포에 가까워진다고 설명한다. 직관적으로 말하면, 고차원에서 무작위 회전된 벡터는 특정 몇 개 좌표에 정보가 몰리지 않고 전체 좌표에 고르게 퍼진다. 그 결과 좌표별 분포가 예측 가능해지고, 서로 다른 좌표 사이 상관이 매우 약해진다.

논문이 제시한 좌표 분포는 다음과 같다.

$$f_X(x) = \frac{\Gamma(d/2)}{\sqrt{\pi}\,\Gamma((d-1)/2)}(1-x^2)^{(d-3)/2}, \quad x \in [-1,1].$$

차원이 충분히 크면 이 분포는 사실상 $\mathcal{N}(0,1/d)$에 가까워진다. 이는 실무적으로 매우 중요하다. 원래 고차원 벡터 양자화는 좌표 간 의존성을 고려해야 하므로 복잡한 벡터 코드북 탐색이 필요하지만, TurboQuant는 회전 후 좌표별 독립 근사를 통해 문제를 거의 1차원 최적화로 환원한다. 고차원이 오히려 단순화를 돕는 셈이다.

논문이 강한 하한을 제시할 수 있는 이유는 샤논 하한(Shannon Lower Bound)을 사용하기 때문이다. 일반 분포 $p_X$에 대해 총 비트 복잡도 $B$인 모든 손실 압축기가 달성 가능한 최적 MSE 왜곡률 $D(p_X,B)$는 엔트로피와 상호정보량에 의해 하한이 주어진다. 논문은 이를 구면 균등분포에 특화하여, 단위 구면 위 입력에 대해

$$D(B) \ge 2^{-2B/d}$$

라는 간결한 하한을 얻는다. $B = b d$로 두면 결국 $4^{-b}$ 꼴의 하한이 된다. 다시 말해, 어떤 양자화 알고리즘도 비트폭 $b$에서 이보다 훨씬 더 빨리 왜곡을 줄일 수는 없다. TurboQuant의 중요성은 바로 이 하한에 상수배 차이만으로 접근한다는 데 있다.

저자들은 더 나아가 Yao의 minimax 원리를 이용한다. 이는 확률적 알고리즘의 최악 입력에 대한 성능을, 무작위 입력에 대한 결정론적 알고리즘의 성능으로 바꿔 생각하게 해주는 도구다. 이 원리를 통해 논문은 무작위 회전과 확률적 양자화를 사용하는 TurboQuant 같은 방법이 최악 입력에 대해서도 강한 의미의 보장을 가진다고 주장할 수 있다. 즉, 특정 데이터셋에서만 우연히 잘 되는 방법이 아니라, 문제 자체의 한계에 근접한 방법이라는 점이 핵심이다.

| 비트폭 $b$ | TurboQuantmse 세부 상한 | TurboQuantprod 세부 상한 | 정보이론적 하한 |

|---|---|---|---|

| 1 | $D_{\mathrm{mse}} \approx 0.36$ | $D_{\mathrm{prod}} \approx 1.57/d$ | $4^{-1}=0.25$ |

| 2 | $D_{\mathrm{mse}} \approx 0.117$ | $D_{\mathrm{prod}} \approx 0.56/d$ | $4^{-2}=0.0625$ |

| 3 | $D_{\mathrm{mse}} \approx 0.03$ | $D_{\mathrm{prod}} \approx 0.18/d$ | $4^{-3}=0.015625$ |

| 4 | $D_{\mathrm{mse}} \approx 0.009$ | $D_{\mathrm{prod}} \approx 0.047/d$ | $4^{-4}=0.00390625$ |

이 표가 보여주는 가장 중요한 메시지는, TurboQuant가 저비트 영역에서도 하한과 지나치게 멀지 않다는 사실이다. 논문은 특히 1비트의 경우 TurboQuant가 최적 대비 약 1.45배 수준의 왜곡만 낸다고 강조한다. 많은 압축 기법이 저비트로 갈수록 품질이 급격히 무너지는 것과 달리, TurboQuant는 이론적으로도 저비트에서 의외로 강한 근접성을 유지한다. 이는 장기적으로 초저비트 KV 캐시 압축이나 검색 인프라 설계에서 매우 중요한 함의다.

3. 방법론: TurboQuant의 두 단계 설계와 근최적성의 구조

3.1 무작위 회전과 좌표별 최적 스칼라 양자화: TurboQuantmse

TurboQuantmse는 MSE 최소화를 목표로 하는 기본 버전이다. 입력 벡터 $x \in S^{d-1}$가 주어지면, 먼저 무작위 회전 행렬 $\Pi \in \mathbb{R}^{d \times d}$를 곱해 $y = \Pi x$를 만든다. 논문은 이 회전 행렬을 정규분포 난수 행렬의 QR 분해로 생성할 수 있다고 설명한다. 이 단계의 목적은 원래 벡터가 가진 데이터 의존적 구조를 제거하고, 회전된 좌표들이 구면 균등분포의 성질을 갖도록 만드는 것이다.

그 다음 단계는 놀랍게도 매우 단순하다. 회전된 벡터의 각 좌표 $y_j$에 대해, 미리 계산된 코드북의 가장 가까운 중심값 $c_k$를 선택한다. 즉, 각 좌표를 독립적인 스칼라 양자화 문제로 다루는 것이다. 복원 시에는 각 인덱스를 중심값으로 되돌린 다음, 마지막에 $\Pi^\top$를 곱해 원래 좌표계로 역회전한다. 이를 식으로 쓰면 양자화와 복원은 개략적으로 다음 형태를 가진다.

$$\text{Quant}_{\mathrm{mse}}(x):\; y=\Pi x,\quad \mathrm{idx}_j = \arg\min_{k \in [2^b]} |y_j-c_k|,$$

$$\text{DeQuant}_{\mathrm{mse}}(\mathrm{idx}):\; \tilde y_j = c_{\mathrm{idx}_j},\quad \tilde x = \Pi^\top \tilde y.$$

이 과정의 본질은 최적 벡터 양자화의 어려운 부분을 1차원 연속 k-means 문제로 환원한다는 데 있다. 논문은 좌표 분포 $f_X$에 대해 $2^b$개의 중심값 $c_1, \dots, c_{2^b}$를 찾는 문제를 다음 최적화로 정의한다.

$$C(f_X,b)=\min_{-1 \le c_1 \le \cdots \le c_{2^b} \le 1} \sum_{i=1}^{2^b}\int_{(c_{i-1}+c_i)/2}^{(c_i+c_{i+1})/2}|x-c_i|^2 f_X(x)dx.$$

논문은 이 최적화를 Max-Lloyd 알고리즘으로 수치적으로 풀어, 실용적인 비트폭 범위에 대한 코드북을 미리 저장해둔다고 설명한다. 다시 말해 TurboQuant는 매번 데이터셋을 보고 학습하는 것이 아니라, 차원과 비트폭에 맞는 최적 스칼라 코드북을 사전에 구축해두고 즉시 사용할 수 있다. 이것이 바로 논문이 강조하는 온라인 적용성의 핵심이다.

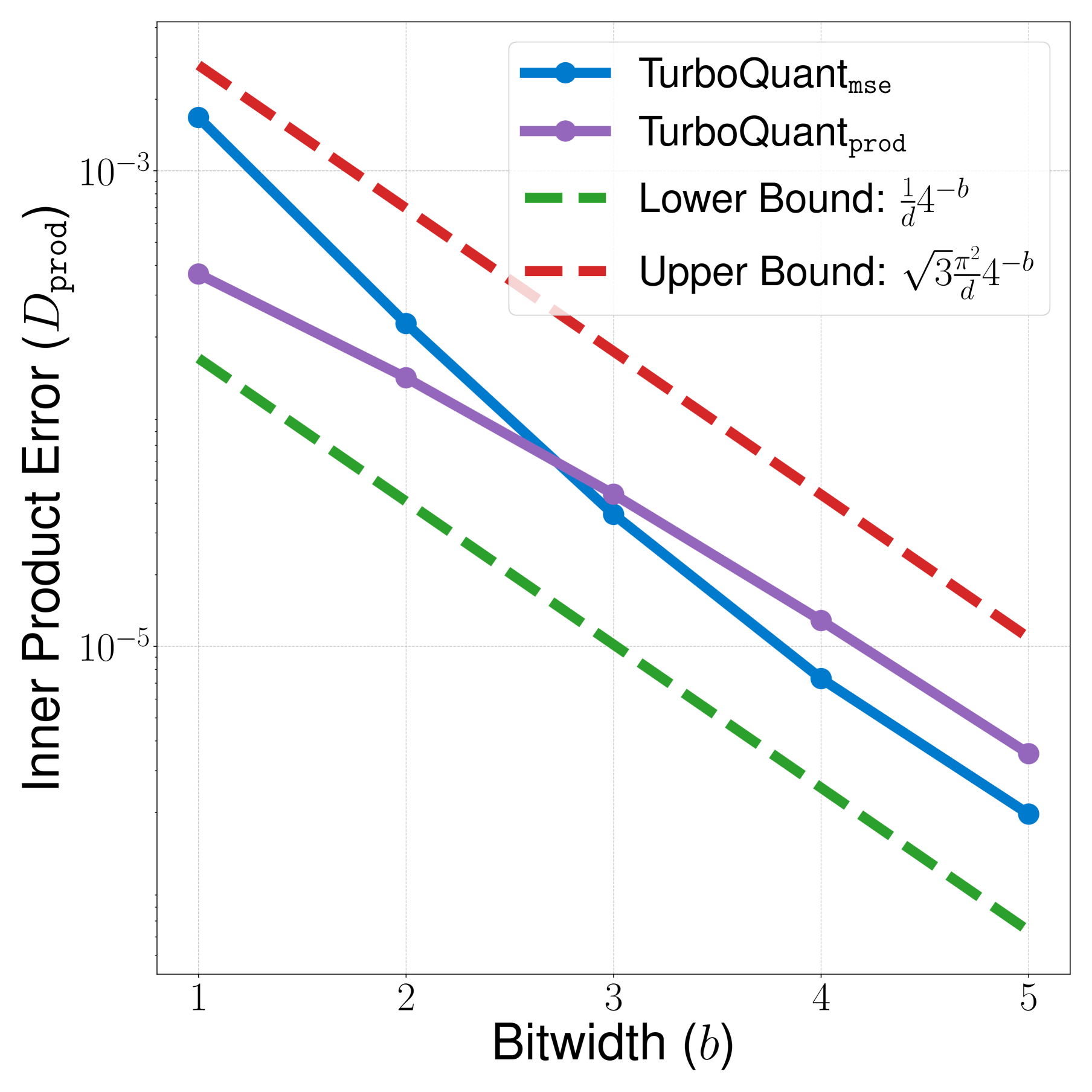

Figure 2: 비트폭에 따른 이론적 경계와 실험값의 비교. TurboQuant는 내적 오차와 MSE 모두에서 하한에 비교적 가깝게 위치하며, 특히 저비트에서도 근최적 거동을 보인다.

논문이 증명한 결과에 따르면, TurboQuantmse는 임의의 최악 벡터 $x$에 대해

$$D_{\mathrm{mse}}(Q_{\mathrm{mse}}) \le \frac{\sqrt{3\pi}}{2} \cdot 4^{-b}$$

를 만족한다. 즉 하한 $4^{-b}$와 비교해 상수배만 차이 난다. 이 상수 $\sqrt{3\pi}/2 \approx 1.535$가 아니라 전체 정리 해석에서 논문이 언급하는 근최적 계수는 약 2.7 수준인데, 이는 내적 버전과 전체 프레임워크를 함께 해석한 상수 배경을 포함한 설명이다. 중요한 것은 왜곡률의 지수적 감소 속도 자체가 최적이라는 점이다. 비트가 하나 늘어날 때마다 왜곡이 대략 4배 감소하는 이상적인 비율을 달성한다는 의미다.

여기서 독자가 놓치기 쉬운 포인트는, TurboQuantmse가 사실상 벡터 양자화와 스칼라 양자화의 장점을 혼합하고 있다는 점이다. 표면적으로는 좌표별 스칼라 양자화지만, 그 전에 무작위 회전으로 전체 벡터 구조를 섞어놓기 때문에 일반적인 독립 좌표 양자화보다 훨씬 강한 성질을 얻는다. 논문은 이를 통해 복잡한 데이터 종속 코드북 학습 없이도 고차원 구조를 활용할 수 있다고 본다. 다시 말해 TurboQuant의 성능 원천은 거대한 코드북이 아니라, 회전이 만들어내는 분포 정규화에 있다.

- 무작위 회전은 입력 분포를 고차원 구면 분포의 통제 가능한 좌표 분포로 바꾼다.

- 좌표별 양자화는 독립적인 1차원 문제로 환원되며, 코드북은 사전 계산 가능하다.

- 복원은 단순한 역회전으로 끝나므로 구현 복잡도가 낮다.

- TurboQuantmse는 MSE 기준에서 거의 최적인 감소율 $4^{-b}$를 달성한다.

3.2 왜 MSE 최적화만으로는 부족한가: TurboQuantprod와 잔차 QJL

그러나 논문은 여기서 멈추지 않는다. 저자들은 MSE 최적 양자화기가 내적 추정에는 편향을 만들 수 있다고 지적한다. 특히 $b=1$일 때 충분히 큰 차원에서는 TurboQuantmse의 양자화가 사실상 부호(sign) 기반 양자화와 유사해지고, 이 경우 복원 벡터와 질의 벡터의 내적 기댓값이 원래 내적의 $2/\pi$배로 줄어드는 곱셈 편향이 생긴다. 즉 평균적으로 체계적 과소추정이 발생하는 것이다. 검색 시스템에서는 이런 편향이 순위 자체를 무너뜨릴 수 있다.

이 문제를 해결하기 위해 논문은 TurboQuantprod를 제안한다. 구조는 2단계다. 먼저 목표 비트폭 $b$보다 1비트 적은 $b-1$비트로 TurboQuantmse를 적용한다. 그런 다음 원래 벡터와 MSE 복원 벡터의 차이인 잔차(residual) $r = x - Q^{-1}_{\mathrm{mse}}(Q_{\mathrm{mse}}(x))$를 계산한다. 이 잔차는 이미 크기가 작기 때문에, 여기에 1비트 QJL(Quantized Johnson-Lindenstrauss) 변환을 적용해 부호 정보만 저장해도 내적 보정 효과를 얻을 수 있다.

논문이 제안한 양자화 구조는 다음과 같이 정리된다.

$$Q_{\mathrm{prod}}(x) = \Big(Q_{\mathrm{mse}}(x),\; Q_{\mathrm{qjl}}(r),\; \|r\|_2\Big), \quad r = x-Q^{-1}_{\mathrm{mse}}(Q_{\mathrm{mse}}(x)).$$

복원 시에는 먼저 MSE 복원 벡터를 만든 뒤, QJL이 제공하는 잔차 추정치를 더한다. 논문이 제시한 의사코드를 풀어 쓰면, 무작위 가우시안 행렬 $S$를 사용해 $\mathrm{sign}(Sr)$를 저장하고, 복원 시에는 $\sqrt{\pi/2d}\,\|r\|_2 S^\top qjl$ 형태로 잔차를 다시 근사한다. 이 설계의 중요한 점은 잔차 항이 무편향 내적 추정을 보장한다는 것이다. 즉 MSE 경로가 제공하는 저왜곡 복원과, QJL 경로가 제공하는 무편향 보정을 조합한 구조라고 볼 수 있다.

논문은 이 구조에 대해 임의의 $x, y$에 대해

$$\mathbb{E}[\langle y, \tilde x \rangle] = \langle y, x \rangle$$

를 만족하며, 동시에

$$D_{\mathrm{prod}} \le \frac{\sqrt{3\pi^2}\,\|y\|_2^2}{d} \cdot 4^{-b}$$

의 상한을 갖는다고 증명한다. 즉, 내적 오차 역시 $4^{-b}$에 비례하는 이상적 감소율을 가진다. 실무적 관점에서 보면 TurboQuantprod는 검색이나 어텐션 계산처럼 내적이 본질적인 태스크를 위한 버전이고, TurboQuantmse는 복원 오차 자체가 중요한 태스크에 더 직접적인 버전이다. 논문은 두 목표를 억지로 하나의 양자화기로 통합하지 않고, 목적에 따라 분리 설계한 셈이다.

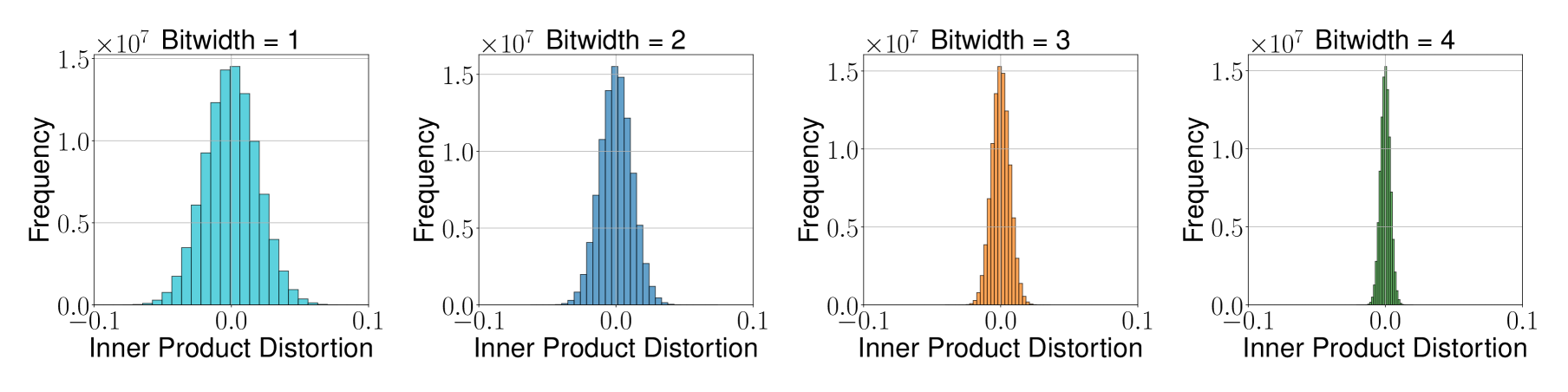

Figure 3: TurboQuantprod와 TurboQuantmse의 내적 오차 분포 비교. TurboQuantprod는 모든 비트폭에서 중심이 0에 가깝게 유지되어 무편향성을 보여주고, TurboQuantmse는 저비트에서 편향이 나타난다.

이 부분이 논문의 가장 큰 설계적 통찰 중 하나다. 보통 양자화 연구에서는 MSE가 줄어들면 다른 다운스트림 연산도 함께 좋아질 것이라고 암묵적으로 기대하는 경우가 많다. 하지만 논문은 이 가정을 정면으로 반박한다. MSE가 작다는 것과 내적 추정이 무편향이라는 것은 별개의 조건이며, 실제 검색과 어텐션 품질은 후자에 훨씬 민감할 수 있다는 것이다. 따라서 TurboQuantprod는 단순한 변형이 아니라, "어떤 구조를 보존해야 실제 태스크 품질이 유지되는가"를 반영한 목적지향 설계라고 보는 편이 정확하다.

| 구성 | TurboQuantmse | TurboQuantprod |

|---|---|---|

| 최적화 목표 | 재구성 MSE 최소화 | 내적 추정 무편향 + 낮은 내적 오차 |

| 핵심 절차 | 무작위 회전 후 좌표별 최적 스칼라 양자화 | $(b-1)$비트 MSE 양자화 + 잔차에 대한 1비트 QJL |

| 편향 특성 | 저비트에서 내적 편향 가능 | 무편향 보장 |

| 적합한 응용 | 복원 품질 중심 압축 | 어텐션, 검색, 최근접 이웃 탐색 |

3.3 하한과 근최적성: 이 논문이 단순한 경험적 방법이 아닌 이유

논문의 이론 섹션이 특히 인상적인 이유는, TurboQuant의 상한만 제시하는 것이 아니라 어떤 알고리즘도 피할 수 없는 하한을 함께 제시한다는 점이다. 정리 3에서 저자들은 임의의 무작위 양자화 알고리즘 $Q: S^{d-1} \rightarrow \{0,1\}^{bd}$와 임의의 복원 맵에 대해, 어떤 어려운 입력 $x$가 존재하여

$$D_{\mathrm{mse}}(Q) \ge 4^{-b}$$

를 만족하고, 또한 어떤 $y$에 대해서는

$$D_{\mathrm{prod}}(Q) \ge \frac{1}{d}4^{-b}$$

가 성립한다고 보인다. 다시 말해 $4^{-b}$보다 더 좋은 지수 감소율을 보이는 범용 양자화기는 존재할 수 없다는 뜻이다. TurboQuant는 이 하한에 상수배 차이만 두고 접근하므로, 적어도 왜곡률 차원에서는 이미 매우 좋은 위치에 있다.

이 분석은 실험 해석에도 중요한 기준점을 제공한다. 많은 양자화 논문이 "기존 대비 몇 점 향상"을 말하지만, 그 수치가 본질적 개선인지 아니면 구현 차이에서 나온 미세한 이득인지는 판단하기 어렵다. TurboQuant는 하한이 있기 때문에, 실험 결과가 단순히 몇 개 벤치마크에서 운 좋게 좋았다는 식으로 해석되지 않는다. 오히려 "이 정도면 문제 자체의 한계에 상당히 가깝다"는 해석이 가능하다. 특히 저비트에서조차 이론과 실험이 비슷한 추세를 보이는 점은 설계와 분석이 잘 맞물렸음을 보여준다.

또한 논문은 코드북 인덱스에 대해 엔트로피 인코딩을 덧붙이면 평균 비트폭을 더 줄일 수 있다고 언급한다. 예를 들어 4비트 설정에서 최적 접두부 부호를 쓰면 약 5% 정도 추가 절감이 가능하다고 설명한다. 다만 저자들은 이 이득이 구현 복잡성 대비 크지 않다고 보고, 본 논문에서는 단순성과 속도를 위해 채택하지 않는다. 이 대목은 실무 감각을 보여준다. 즉, 정보이론적으로 가능한 모든 최적화를 다 넣기보다, 실제 시스템에 바로 쓸 수 있는 균형점을 택한 것이다.

정리하면 방법론 섹션의 메시지는 명확하다. 무작위 회전은 분포를 통제 가능한 형태로 만들고, 좌표별 최적 스칼라 양자화는 구현 가능성을 보장하며, 잔차 QJL은 내적 무편향성을 회복하고, 샤논 하한과 minimax 분석은 이 전체 설계가 거의 최적인 이유를 설명한다. 이 네 조각이 서로 긴밀하게 맞물려 있기 때문에 TurboQuant는 단순한 휴리스틱이 아니라, 이론과 시스템 관점을 함께 만족시키는 설계로 읽힌다.

3.4 단계별 알고리즘 해설: 실제 구현 관점에서 본 TurboQuant의 데이터 흐름

방법론을 구현 순서대로 다시 풀어보면 TurboQuant의 장점이 더 분명해진다. 먼저 시스템은 차원 $d$와 목표 비트폭 $b$에 대해 회전 행렬과 코드북을 준비한다. 회전 행렬은 한 번 샘플링한 뒤 반복 사용해도 되고, 서비스 단위로 고정된 시드에서 생성해 재현성을 확보할 수도 있다. 코드북은 Max-Lloyd 알고리즘으로 사전 계산된 중심값 배열이다. 이후 실제 벡터가 입력되면, 첫 단계는 단순한 행렬곱으로 벡터를 회전시키는 것이다. 이 회전은 입력 데이터의 분포가 무엇이든 간에 좌표계에서 정보가 특정 축에 몰리는 현상을 줄여준다. 즉, 복잡한 데이터 적응을 별도로 학습하지 않고도, 양자화가 다루기 쉬운 분포를 인위적으로 만든다.

그 다음 각 좌표는 가장 가까운 코드북 중심값 인덱스로 치환된다. 이 과정은 GPU나 SIMD 환경에서 매우 효율적으로 수행될 수 있다. 특히 코드북 크기가 $2^b$개로 고정되어 있으므로, 비교 연산 구조도 단순하다. 논문이 강조하는 "온라인"이라는 표현은 바로 이 지점에서 실감난다. 새로운 벡터가 들어올 때 해야 할 일은 결국 회전과 최근접 중심 탐색뿐이기 때문이다. 오프라인 학습 기반 방법처럼 전체 데이터셋을 다시 훑거나, 헤시안 근사를 다시 계산하거나, 군집 중심을 재학습할 필요가 없다. 이는 대규모 서비스에서 지연 분산을 안정화하는 데도 유리하다.

TurboQuantprod의 경우에는 여기에 한 단계가 더 추가된다. 먼저 MSE 경로를 통해 얻은 복원 벡터를 원래 벡터에서 빼서 잔차를 만든다. 이 잔차는 이미 크기가 작으므로, 여기에 대해 고비용의 세밀한 양자화를 할 필요가 없다. 대신 논문은 QJL을 사용해 부호 정보만 저장한다. 이 선택이 중요한 이유는, 잔차의 절대 재구성보다 내적 보정이 목적이기 때문이다. 즉 TurboQuantprod는 원본 벡터 전체를 완벽히 복원하려는 시스템이 아니라, 질의 벡터와의 점수 계산에서 평균적으로 치우치지 않는 방향으로 설계된 시스템이다. 이처럼 목표 연산에 맞춰 압축 경로를 분리한 것은 논문이 매우 실용적으로 설계되었다는 신호다.

복원 단계도 마찬가지로 구조가 명쾌하다. TurboQuantmse는 중심값으로 좌표를 복원한 뒤 역회전하면 끝난다. TurboQuantprod는 여기에 QJL 기반 잔차 추정치를 더한다. 이때 중요한 것은 잔차 추정이 개별 좌표를 정확히 맞추는 데 목적이 있는 것이 아니라, 전체적으로 내적 오차의 편향을 제거하도록 설계되었다는 점이다. 그래서 TurboQuantprod의 복원 벡터는 MSE 관점에서 반드시 TurboQuantmse보다 더 좋은 것은 아니지만, 검색이나 어텐션처럼 내적이 핵심인 연산에서는 더 의미 있는 복원이라 할 수 있다. 논문이 두 버전을 분리한 이유가 다시 한번 드러나는 부분이다.

실제로 서비스 환경에서 이 구조는 여러 층의 최적화 여지를 제공한다. 회전 연산은 배치화할 수 있고, 코드북 조회는 테이블화할 수 있으며, 잔차 QJL는 필요한 시나리오에만 선택적으로 적용할 수 있다. 예를 들어 단순 캐시 저장에는 TurboQuantmse를 쓰고, 검색 인덱스나 어텐션 민감 레이어에는 TurboQuantprod를 쓰는 하이브리드 설계도 가능하다. 논문은 이러한 시스템 설계를 직접 실험하지 않았지만, 방법론이 이런 조합을 자연스럽게 허용한다는 점 자체가 큰 강점이다. 다시 말해 TurboQuant는 하나의 고정된 알고리즘이라기보다, 온라인 저왜곡 벡터 압축을 위한 모듈형 설계 원리라고 보는 것이 더 정확하다.

이 구현적 관점에서 보면 논문의 기여는 세 층으로 나뉜다. 첫째, 이론적으로는 왜 고차원에서 좌표별 양자화가 정당화되는지 설명한다. 둘째, 알고리즘적으로는 회전-양자화-역회전이라는 짧고 단순한 경로를 제시한다. 셋째, 시스템적으로는 온라인 처리와 즉시 인덱싱, 저비용 캐시 압축에 모두 적용될 수 있는 실용성을 보여준다. 많은 논문이 이 셋 중 하나에만 강한 반면, TurboQuant는 세 층을 동시에 연결한다. 이 점이 바로 본 논문이 단순한 이론 정리나 벤치마크 개선을 넘어서는 이유다.

3.5 저비트 구간의 의미: 왜 1~4비트 상한이 특별히 중요한가

논문이 $b=1,2,3,4$에 대한 세부 상한을 별도로 제시한 이유도 생각해볼 필요가 있다. 많은 정보이론 논문은 점근적 결과를 제시하는 데서 멈춘다. 그러나 실제 시스템은 대부분 매우 낮은 비트 영역에서 운영된다. KV 캐시 압축에서 8비트는 충분히 안전하지만 메모리 절감 효과가 제한적일 수 있고, 진짜 비용 절감은 4비트 이하에서 본격적으로 발생한다. 따라서 저자들이 1비트부터 4비트까지 구체적인 수치를 제시했다는 것은, 이 논문이 처음부터 실무적 저비트 영역을 염두에 두고 설계되었음을 보여준다.

1비트 구간은 특히 의미가 크다. 이 영역에서는 많은 양자화기가 사실상 부호 함수 수준으로 단순화되며, 그 결과 큰 편향이나 심각한 표현 손실이 생기기 쉽다. 논문은 이 극단적 조건에서도 TurboQuant가 하한 대비 지나치게 멀지 않은 왜곡을 낸다는 점을 강조한다. 이는 단지 숫자가 작다는 의미가 아니라, 고차원 벡터 구조를 무작위 회전으로 균등화한 뒤 스칼라 양자화한다는 전략이 저비트에서조차 안정적으로 작동한다는 뜻이다. 후속 초저비트 KV 캐시 연구가 이 논문을 많이 참조하게 될 가능성이 큰 이유도 여기에 있다.

또한 2비트와 3비트는 오늘날 실제 시스템 최적화에서 매우 중요한 영역이다. 2비트는 극단적 압축을 가능하게 하지만 오차 관리가 어렵고, 3비트는 구현 복잡도는 다소 올라가도 품질 대비 메모리 효율이 좋아지는 경우가 많다. 논문이 2.5비트와 3.5비트 같은 비정수 비트폭 실험을 수행한 것도, 결국 이러한 저비트 실무 구간에서 더 세밀한 제어가 필요하기 때문이다. 즉 이론의 단위는 정수 비트폭이지만, 시스템의 단위는 채널 그룹별 혼합 정밀도일 수 있으며, TurboQuant는 이 둘을 자연스럽게 연결한다.

이 점을 종합하면, 저비트 세부 상한은 단순한 부록용 숫자가 아니다. 오히려 TurboQuant가 "점근적으로만 좋은 방법"이 아니라, 실제로 사람들이 가장 원하는 비트 구간에서 강한 방법임을 보여주는 핵심 근거다. 논문의 실험이 2.5비트와 3.5비트에서 좋은 성능을 낸 것도 우연이 아니라, 이미 이론 단계에서 저비트 동작을 세밀하게 의식하고 설계했기 때문이라고 해석할 수 있다.

4. 실험 설정: 이론을 실제 KV 캐시와 검색 워크로드로 가져오기

4.1 데이터셋 및 벤치마크: 검증 실험, 장문맥 평가, 최근접 이웃 검색

실험은 세 층위로 구성된다. 첫째는 이론적 왜곡 분석을 실제 데이터에 대입하는 경험적 검증 실험이다. 저자들은 DBpedia Entities 데이터셋을 OpenAI3 임베딩으로 1536차원 공간에 매핑한 뒤, 100,000개 샘플을 학습 집합처럼 사용하고 별도로 1,000개 질의 벡터를 추출해 내적 오차 특성을 분석한다. 이 단계의 목적은 TurboQuantmse와 TurboQuantprod가 이론에서 예측한 분포와 편향 구조를 실제 임베딩에서도 보이는지 확인하는 데 있다.

둘째는 LLM KV 캐시 압축 시나리오다. 여기서 논문은 Needle-In-A-Haystack 테스트와 LongBench-E를 사용한다. Needle-In-A-Haystack은 긴 문서 안 어딘가에 숨겨진 문장을 찾아내는 능력을 평가하므로, 장문맥 검색과 회수 능력을 잘 반영한다. LongBench-E는 단일 문서 QA, 다중 문서 QA, 요약, few-shot, synthetic, 코드 등 다양한 장문맥 태스크를 균형 있게 담고 있어, KV 캐시 압축이 실제 생성 품질에 어떤 영향을 주는지 보여준다.

셋째는 최근접 이웃 탐색 실험이다. 여기서는 DBpedia OpenAI3 임베딩의 1536차원과 3072차원 버전, 그리고 보다 저차원인 GloVe 임베딩(d=200)을 사용한다. 학습 세트는 100,000개이며, 질의 세트는 DBpedia 계열에서는 1,000개, GloVe에서는 10,000개를 사용한다. 평가지표는 top-k 내에 진짜 최고 내적 이웃이 포함되는 비율인 Recall@1@k이다. 이 설정은 TurboQuant가 단순히 LLM용 KV 캐시 기법이 아니라, 더 넓은 벡터 검색 환경에서도 유효한 범용 벡터 양자화기임을 보여주기 위한 장치다.

실험 설계 전반에서 중요한 점은 저자들이 TurboQuant를 특정 상황에만 유리하도록 구성하지 않았다는 것이다. 오히려 이론 검증, 장문맥 추론, 벡터 검색이라는 서로 성격이 다른 환경에서 같은 아이디어가 얼마나 일관되게 통하는지를 본다. 이는 논문의 주장, 즉 TurboQuant가 어떤 개별 태스크 전용 휴리스틱이 아니라 일반적인 고차원 벡터 압축 원리라는 점을 강화한다.

- 이론 검증: DBpedia Entities + OpenAI3 1536차원 임베딩

- 장문맥 회수: Llama-3.1-8B-Instruct 기반 Needle-In-A-Haystack

- 장문맥 생성: LongBench-E + Llama-3.1-8B-Instruct / Ministral-7B-Instruct

- 검색: GloVe 200차원, OpenAI3 1536/3072차원 최근접 이웃 탐색

4.2 구현 세부사항: 비정수 비트폭과 아웃라이어 채널 처리

LongBench 실험에서 논문은 2.5비트와 3.5비트라는 비정수 비트폭을 사용한다. 이는 단순한 마케팅 숫자가 아니라, 채널을 아웃라이어(outlier)와 일반 채널로 나눠 서로 다른 비트폭을 부여하는 구조에서 나온다. 논문은 2.5비트 설정의 구체적 예로 128개 채널 중 32개 아웃라이어 채널에 3비트를 할당하고, 나머지 96개 채널에는 2비트를 할당한다고 설명한다. 이 경우 평균 비트폭은 $(32\times3 + 96\times2)/128 = 2.5$가 된다.

이 전략은 기존 양자화 문헌에서도 자주 등장하는 아웃라이어 우대 원리를 따른다. 전체 채널 중 일부는 분산이나 중요도가 매우 커서, 이들을 일반 채널과 동일하게 저비트로 양자화하면 전체 품질이 크게 떨어질 수 있다. TurboQuant는 이러한 구조를 받아들이되, 나머지 대다수 채널에 대해서는 매우 낮은 비트폭을 적용해 전체 메모리 사용량을 크게 줄인다. 즉 비정수 비트폭은 압축률을 애매하게 표시하려는 장식이 아니라, 실제 시스템 구현에서 합리적인 절충점이다.

또 하나 중요한 세부사항은 TurboQuant가 생성 단계의 스트리밍 토큰에도 양자화를 적용한다는 점이다. 논문은 KIVI나 PolarQuant 같은 일부 기존 방법이 생성 중 새로 생기는 토큰에 대해서는 양자화를 적용하지 않는다고 언급한다. 반면 TurboQuant는 생성 프로세스 전체를 압축 대상으로 삼는다. 이는 동일 평균 품질이라도 실제 메모리 절감과 장문맥 처리 효율 측면에서 더 공격적이고 실용적인 설정이라 할 수 있다.

최근접 이웃 검색 실험에서는 비교 대상인 PQ가 LUT256 기반 구현을 사용하도록 조정되었다. 논문은 LUT16이 더 빠르지만 품질이 크게 떨어졌기 때문에, 속도와 정확도의 균형을 위해 LUT256을 택했다고 설명한다. 또한 RabitQ는 완전한 벡터화 구현이 없어 CPU에서 느리며, 실제 비트 비용도 보고된 수치보다 더 들 수 있다고 지적한다. 이는 TurboQuant가 단지 이상적인 조건에서만 빠른 것이 아니라, 동일 비교 틀 안에서도 실용 구현상의 이점을 가진다는 주장을 보강한다.

4.3 베이스라인: 무엇과 비교했는가

Needle-In-A-Haystack와 LongBench 실험에서 TurboQuant는 SnapKV, PyramidKV, KIVI, PolarQuant와 비교된다. SnapKV와 PyramidKV는 토큰 수준 압축에 가깝고, KIVI는 스칼라 양자화 기반, PolarQuant는 보다 강한 이론적 성격을 가진 양자화기라는 점에서 서로 성격이 다르다. TurboQuant가 이들과 함께 평가된다는 것은, 단순히 같은 부류 기법을 이겼다는 것이 아니라 메모리 절감의 서로 다른 철학과 비교되었다는 의미다.

최근접 이웃 검색에서는 Product Quantization(PQ)와 RabitQ가 주요 비교 대상이다. PQ는 오래된 고전이면서도 여전히 널리 쓰이는 검색 인덱싱 기법이고, RabitQ는 보다 최근의 양자화 기반 검색 기법이다. 논문은 PQ가 학습과 평가에 같은 데이터셋을 쓰는 이번 설정에서 오히려 이점이 있다고 인정한다. 그럼에도 TurboQuant가 더 높은 리콜과 압도적으로 빠른 양자화 시간을 보인다고 보고한다.

이러한 베이스라인 선택은 적절하다. 저자들은 TurboQuant를 "무작위 회전 기반 새 이론"이라는 추상적 이야기로만 포장하지 않고, 실제로 현업에서 고려할 법한 주요 경쟁 방법들과 붙여 본다. 따라서 후속 연구나 실무 도입 관점에서도 결과 해석이 비교적 직접적이다.

5. 주요 실험 결과: 이론적 우아함이 실제 품질과 속도로 이어지는가

5.1 경험적 검증: 왜 TurboQuantprod는 무편향이고 TurboQuantmse는 편향되는가

먼저 경험적 검증 실험에서 논문은 TurboQuantprod와 TurboQuantmse를 같은 내적 추정 태스크에 적용해 분포를 비교한다. Figure 3은 비트폭 1, 2, 3, 4에서의 내적 왜곡 분포를 보여준다. 저자들의 핵심 관찰은 명확하다. TurboQuantprod는 모든 비트폭에서 분포 중심이 0 근처에 유지되며, 이는 무편향 추정기라는 이론적 성질과 정확히 대응한다. 반면 TurboQuantmse는 낮은 비트폭에서 오른쪽으로 치우친 분포를 보여, 평균적으로 내적을 편향되게 추정한다.

이 결과는 MSE 최적화와 내적 보존이 다르다는 논문의 주장을 실험적으로 뒷받침한다. 흥미로운 점은 TurboQuantmse의 편향이 비트폭이 증가할수록 줄어든다는 것이다. 즉 비트가 충분히 크면 MSE 최적 양자화기 역시 내적 측면에서 쓸 만해지지만, 바로 그 저비트 구간이 실제 압축이 가장 필요한 구간이다. 논문은 그래서 저비트일수록 TurboQuantprod의 가치가 더 커진다고 해석할 수 있게 만든다.

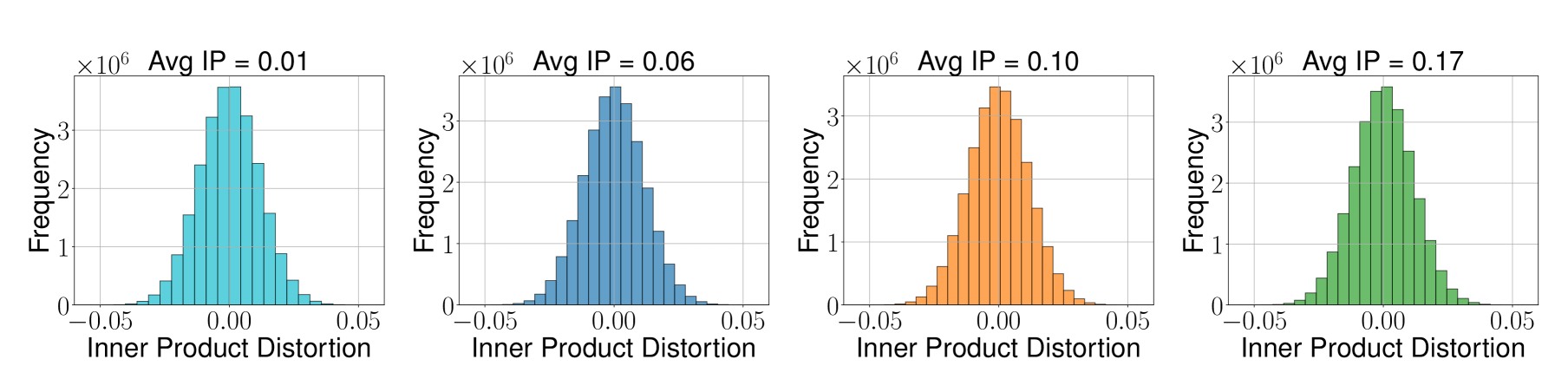

Figure 4는 평균 내적이 서로 다른 질의 그룹에서 오차 분산을 비교한다. 여기서 비트폭은 2비트로 고정된다. TurboQuantprod는 원래 내적의 크기가 달라져도 분산이 거의 일정하게 유지되지만, TurboQuantmse는 평균 내적이 커질수록 편향과 오차 구조가 변한다. 이는 검색이나 어텐션처럼 점수 규모가 상황에 따라 크게 달라지는 환경에서 매우 중요한 차이다. 특정 스코어 범위에서만 안정적인 양자화기는 범용 적용성이 떨어지기 때문이다.

이론과 실험의 정합성이라는 측면에서 보면, 이 부분은 논문의 설득력을 크게 높인다. 많은 이론 논문이 실제 데이터에서는 깔끔한 거동을 보이지 못하는데, TurboQuant는 무편향성, 저비트 편향, 비트 증가에 따른 개선, 점수 크기에 대한 분산 안정성 등 핵심 예측이 전부 실험에서 재현된다. 즉 저자들이 제안한 분해, 즉 MSE 경로와 잔차 QJL 경로의 결합이 단순한 수학적 트릭이 아니라 실제 임베딩 공간에서도 의미 있는 구조라는 뜻이다.

Figure 4: 비트폭 2에서 평균 내적이 달라질 때의 오차 분포. TurboQuantprod는 분산이 안정적이지만, TurboQuantmse는 평균 내적 크기에 따라 왜곡 거동이 달라진다.

5.2 Needle-In-A-Haystack: 4배 이상 압축해도 풀프리시전과 동일 점수

Needle-In-A-Haystack 실험은 TurboQuant의 실전성을 가장 강하게 보여주는 결과 중 하나다. 이 벤치마크에서는 긴 문서 내부에 숨겨진 특정 문장을 회수해야 하므로, 모델이 장문맥에서 필요한 정보를 얼마나 안정적으로 유지하고 검색하는지를 볼 수 있다. 논문은 Llama-3.1-8B-Instruct를 사용하고, 문서 길이를 4k에서 104k 토큰까지 변화시키며 평가한다. 각 방법은 풀 캐시 대비 25% 메모리만 사용하는 0.25 압축 비율에서 비교된다.

결과는 매우 선명하다. SnapKV의 점수는 0.858, PyramidKV는 0.895, KIVI는 0.981, PolarQuant는 0.995, 풀프리시전은 0.997, 그리고 TurboQuant는 0.997이다. 즉 TurboQuant는 이 실험에서 풀프리시전과 완전히 동일한 점수를 기록한다. 논문은 이를 두고 TurboQuant가 4배 이상 압축된 상태에서도 회수 성능을 사실상 잃지 않았다고 해석한다.

이 결과를 해석할 때 중요한 점은, Needle-In-A-Haystack이 단순한 언어 유창성 평가가 아니라 장문맥 정보 접근 능력을 보는 테스트라는 것이다. KV 캐시 압축이 실패하면 대개 오래된 위치의 정보가 소실되거나, 필요 시점에 정확한 어텐션 스코어를 형성하지 못하게 된다. TurboQuant가 풀프리시전과 동일 점수를 냈다는 것은, 적어도 이 회수 과제에서는 핵심 내적 구조가 충분히 잘 보존되었음을 뜻한다. 이것은 논문이 내적 보존을 중시한 설계 철학과 직접 연결된다.

또한 PolarQuant가 0.995로 매우 근접한 점수를 내는 점도 흥미롭다. 논문은 이론적 보장이 있는 양자화 방법들이 토큰 프루닝 방식보다 전반적으로 안정적이라고 해석한다. 즉 어떤 토큰을 버릴지 휴리스틱하게 고르는 방식보다, 모든 벡터를 압축하되 내적 구조를 엄밀하게 보존하는 편이 장문맥 회수에서는 더 나을 수 있다는 것이다. TurboQuant는 바로 이 범주에서 가장 높은 점수를 보인다.

| 방법 | Needle-In-A-Haystack 점수 | 해석 |

|---|---|---|

| SnapKV | 0.858 | 토큰 수준 압축의 성능 저하가 뚜렷함 |

| PyramidKV | 0.895 | SnapKV보다 개선되지만 손실 여전 |

| KIVI | 0.981 | 스칼라 양자화 기반으로 상당히 강함 |

| PolarQuant | 0.995 | 이론 보장을 가진 강력한 베이스라인 |

| Full-Precision | 0.997 | 기준선 |

| TurboQuant | 0.997 | 풀프리시전과 동일한 점수 |

5.3 LongBench: 3.5비트에서 사실상 품질 중립, 2.5비트에서도 경쟁력 유지

LongBench-E 결과는 TurboQuant가 회수 태스크뿐 아니라 실제 장문맥 생성에서도 의미 있는 성능을 유지함을 보여준다. 먼저 Llama-3.1-8B-Instruct에서 풀 캐시의 평균 점수는 50.06이다. KIVI 3비트는 48.50, KIVI 5비트는 50.16, PolarQuant 3.9비트는 49.78, TurboQuant 2.5비트는 49.44, TurboQuant 3.5비트는 50.06이다. 즉 3.5비트 TurboQuant는 평균 점수 기준으로 풀 캐시와 정확히 같은 수치를 기록한다.

세부 항목별로 봐도 결과는 흥미롭다. 3.5비트 TurboQuant는 SingleQA 45.01, MultiQA 45.31, Summarization 26.00, Few-shot 68.63, Synthetic 59.95, Code 46.17을 기록한다. 풀 캐시의 대응 점수는 각각 45.29, 45.16, 26.55, 68.38, 59.54, 46.28이다. 일부 항목은 소폭 낮아졌지만, Few-shot과 Synthetic처럼 오히려 앞서는 항목도 있다. 평균이 동일하다는 사실은 장문맥 생성의 다면적 품질이 전반적으로 보존되었음을 시사한다.

2.5비트 설정도 무시할 수 없다. 평균 점수는 49.44로 풀 캐시 대비 0.62포인트 낮지만, 메모리 절감 효과를 감안하면 상당히 경쟁력 있는 결과다. 특히 MultiQA 44.96, Few-shot 68.01, Synthetic 59.65, Code 45.76 등은 아주 큰 붕괴 없이 유지된다. 반면 Summarization은 24.80으로 하락폭이 비교적 크다. 이는 장거리 압축이 필요한 요약 과제가 KV 캐시 압축에 더 민감할 수 있음을 암시한다. 논문은 이런 결과를 통해 2.5비트가 "거의 무손실"은 아니지만 충분히 실용적인 절충점이라고 해석할 수 있게 한다.

또한 기존 기법과의 비교도 의미심장하다. KIVI가 5비트에서 평균 50.16을 기록하긴 했지만, TurboQuant는 3.5비트에서 50.06으로 매우 근접하며 더 적은 비트를 사용한다. PolarQuant 3.9비트보다도 3.5비트 TurboQuant가 평균이 높다. 즉 TurboQuant의 장점은 단순히 "같은 비트에서 더 좋다"가 아니라, 더 낮은 비트폭으로 비슷하거나 더 나은 품질을 낸다는 데 있다.

| Llama-3.1-8B-Instruct | KV Size | SingleQA | MultiQA | Summarization | Few-shot | Synthetic | Code | Average |

|---|---|---|---|---|---|---|---|---|

| Full Cache | 16 | 45.29 | 45.16 | 26.55 | 68.38 | 59.54 | 46.28 | 50.06 |

| KIVI | 3 | 43.38 | 37.99 | 27.16 | 68.38 | 59.50 | 44.68 | 48.50 |

| KIVI | 5 | 45.04 | 45.70 | 26.47 | 68.57 | 59.55 | 46.41 | 50.16 |

| PolarQuant | 3.9 | 45.18 | 44.48 | 26.23 | 68.25 | 60.07 | 45.24 | 49.78 |

| TurboQuant (ours) | 2.5 | 44.16 | 44.96 | 24.80 | 68.01 | 59.65 | 45.76 | 49.44 |

| TurboQuant (ours) | 3.5 | 45.01 | 45.31 | 26.00 | 68.63 | 59.95 | 46.17 | 50.06 |

Ministral-7B-Instruct 결과는 논문이 하나의 모델에만 특화되지 않았음을 보여준다. 풀 캐시 평균은 49.89이고, TurboQuant 2.5비트는 49.62를 기록한다. 항목별로는 SingleQA 48.38 대 47.53, MultiQA 49.22 대 49.06처럼 일부는 오히려 더 높다. 반면 Summarization 24.91과 Code 46.83은 풀 캐시 대비 다소 낮다. 그럼에도 전체 평균 손실은 매우 작다. 이는 2.5비트처럼 공격적인 압축에서도 모델별 일반성이 어느 정도 유지됨을 보여준다.

| Ministral-7B-Instruct | KV Size | SingleQA | MultiQA | Summarization | Few-shot | Synthetic | Code | Average |

|---|---|---|---|---|---|---|---|---|

| Full Cache | 16 | 47.53 | 49.06 | 26.09 | 66.83 | 53.50 | 47.90 | 49.89 |

| TurboQuant (ours) | 2.5 | 48.38 | 49.22 | 24.91 | 66.69 | 53.17 | 46.83 | 49.62 |

| 해석 | 2.5비트 | 평균 손실이 0.27포인트에 그쳐, 모델이 바뀌어도 TurboQuant의 장문맥 생성 품질이 비교적 안정적으로 유지됨을 보여준다. | ||||||

6. 추가 분석 및 Ablation Study: 검색 품질, 속도, 그리고 구조적 시사점

6.1 최근접 이웃 검색: 높은 리콜과 사실상 0에 가까운 양자화 시간

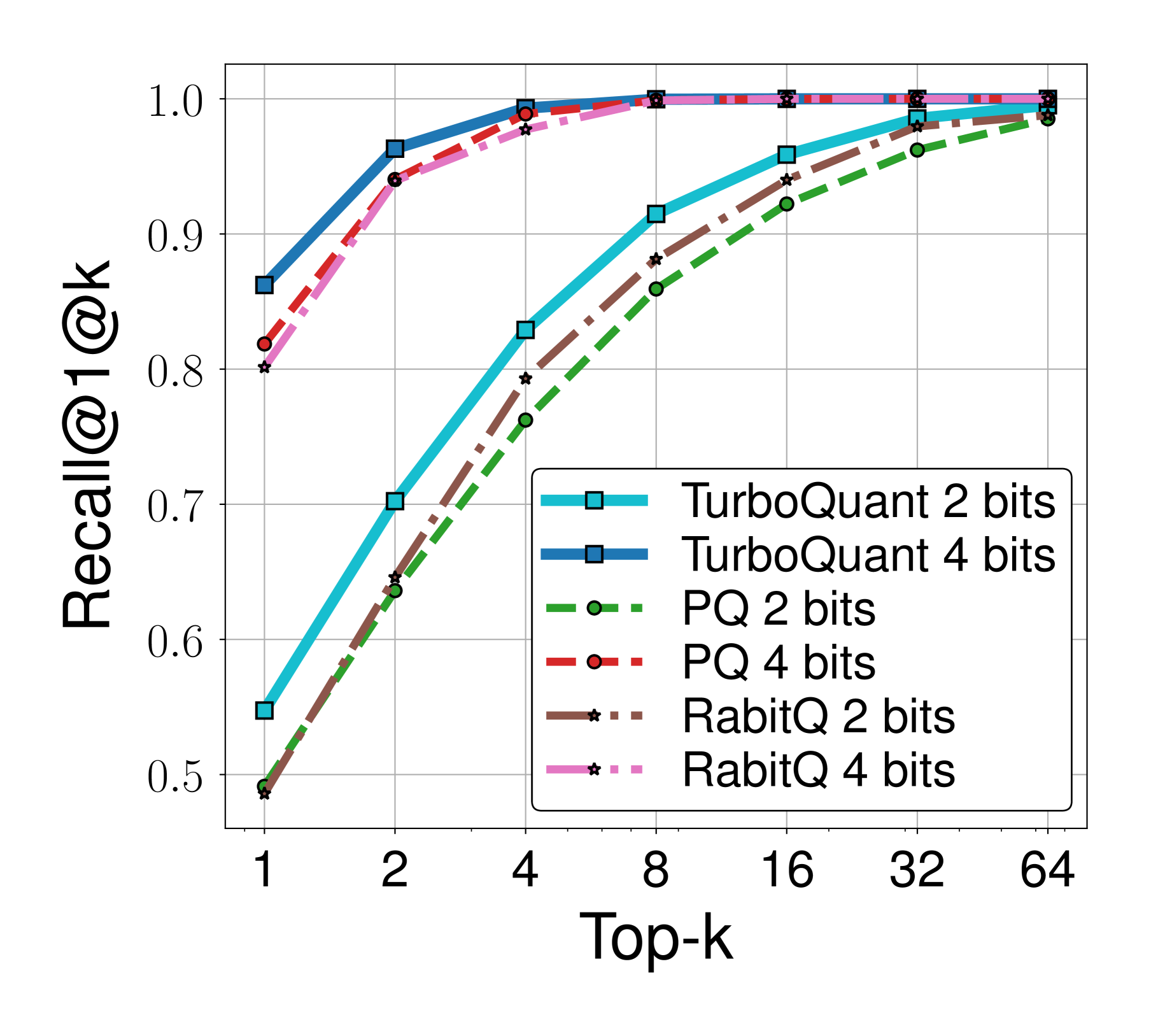

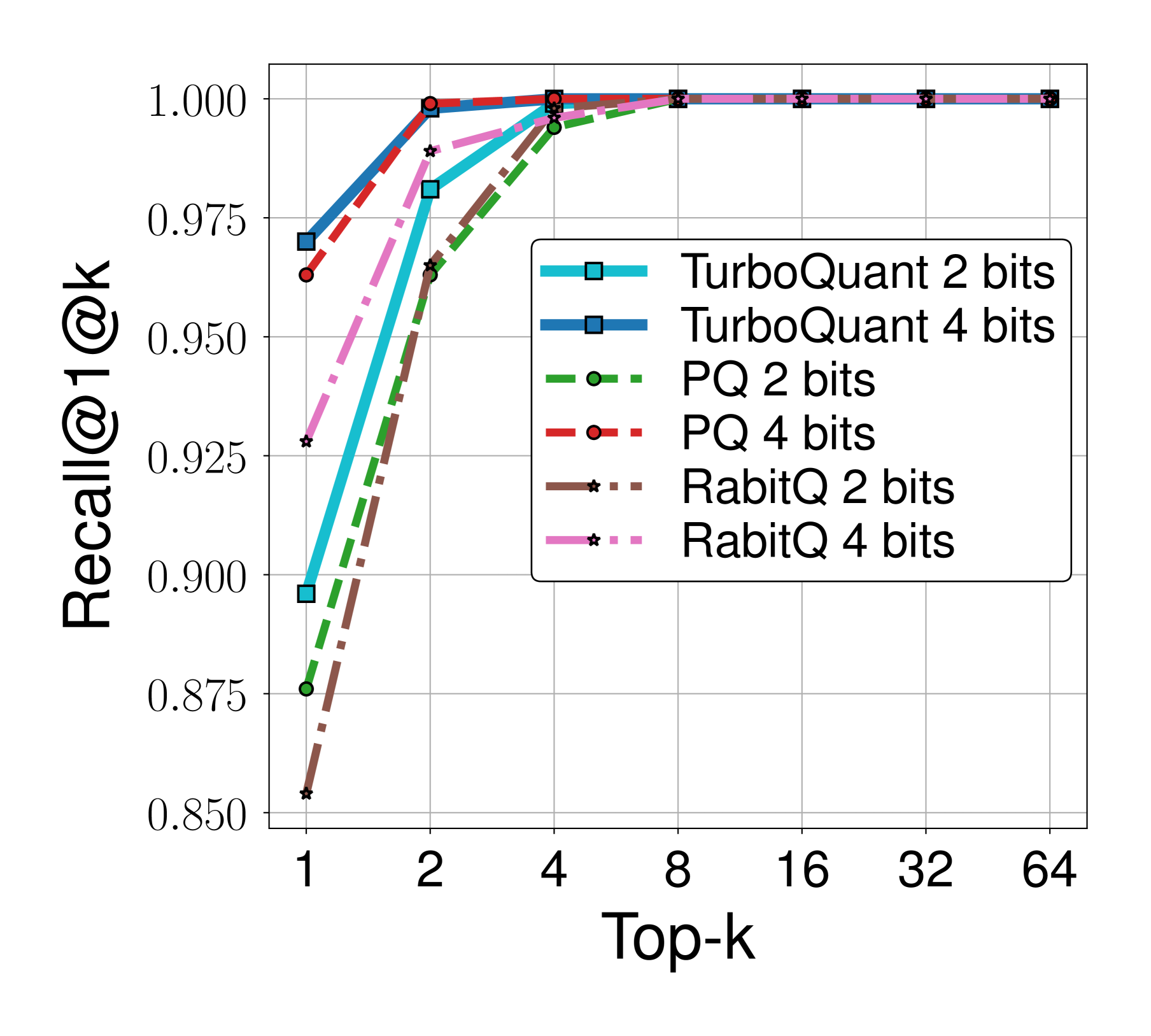

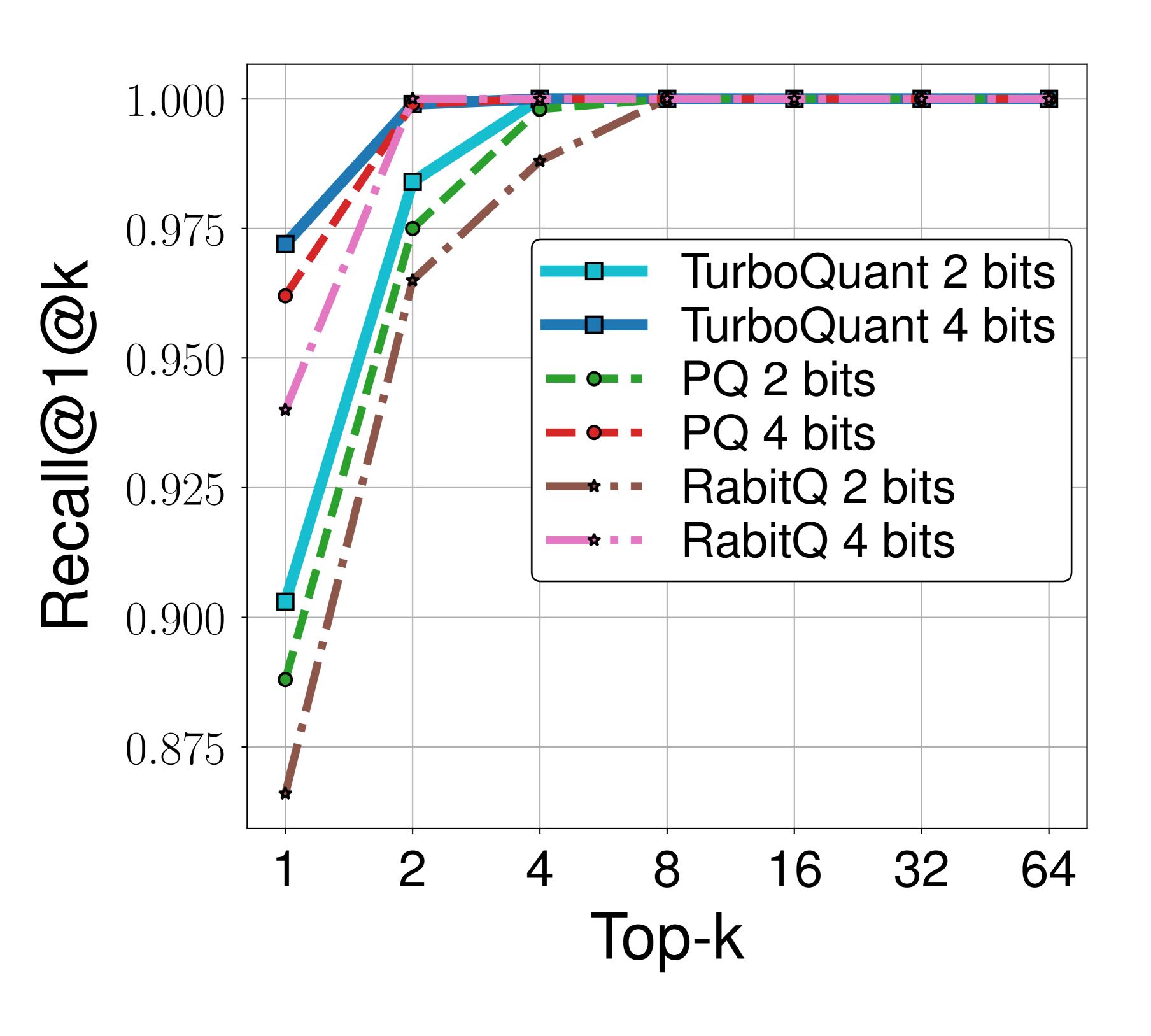

최근접 이웃 검색 실험은 TurboQuant가 LLM KV 캐시 압축에만 쓰이는 기술이 아니라는 점을 분명히 보여준다. 논문은 GloVe 200차원, OpenAI3 1536차원, OpenAI3 3072차원 임베딩에서 Recall@1@k 곡선을 비교한다. Figure 5~7에 따르면 전반적으로 TurboQuant는 2비트와 4비트 모두에서 PQ와 RabitQ를 상회하는 리콜 곡선을 보인다. 논문은 특히 차원이 커질수록 TurboQuant의 상대적 강점이 유지되거나 더 뚜렷해진다고 해석한다.

수치가 더 명시적으로 제시된 것은 양자화 시간이다. 4비트 설정에서 d=200일 때 PQ는 37.04초, RabitQ는 597.25초, TurboQuant는 0.0007초이다. d=1536에서는 각각 239.75초, 2267.59초, 0.0013초이며, d=3072에서는 494.42초, 3957.19초, 0.0021초다. 이 차이는 단순히 "조금 빠르다"가 아니라, 온라인 시스템에서 가능한지 아닌지를 가를 정도로 압도적이다. TurboQuant의 시간은 사실상 즉시 적용 가능한 수준이다.

이 결과는 TurboQuant의 data-oblivious 성격과 직결된다. PQ는 코드북 학습이 필요하고, RabitQ도 벡터화가 제한적이며 부가 오버헤드가 크다. 반면 TurboQuant는 회전과 사전 계산된 코드북 조회만 수행하면 되므로, 새로운 벡터가 들어올 때마다 다시 학습할 것이 거의 없다. 벡터 데이터베이스나 스트리밍 검색 서비스에서는 바로 이 점이 치명적으로 중요하다. 오프라인 인덱싱 시간이 길면 실시간 갱신이 어렵기 때문이다.

논문은 또한 이번 설정에서 PQ가 학습과 평가에 같은 데이터셋을 쓰는 덕분에 오히려 유리한 조건이라고 인정한다. 그럼에도 TurboQuant가 더 높은 리콜과 더 빠른 양자화 시간을 보였다는 점은, 단순히 구현 편의성이 아니라 본질적인 왜곡 특성에서도 경쟁력이 있음을 의미한다. 즉 TurboQuant는 "학습 없는 빠른 대안"이 아니라, 품질과 속도를 동시에 잡은 대안으로 읽어야 한다.

| 방법 | d=200 | d=1536 | d=3072 |

|---|---|---|---|

| Product Quantization | 37.04초 | 239.75초 | 494.42초 |

| RabitQ | 597.25초 | 2267.59초 | 3957.19초 |

| TurboQuant | 0.0007초 | 0.0013초 | 0.0021초 |

Figure 5: GloVe 200차원 임베딩에서의 Recall@1@k 비교. 저차원 환경에서도 TurboQuant는 PQ와 RabitQ 대비 우수한 검색 품질을 유지한다.

Figure 5에서 보이는 저차원 GloVe 결과는 TurboQuant의 강점이 단순히 초고차원 환경에서만 나타나는 현상이 아님을 시사한다. 물론 논문의 이론은 고차원 근사에 크게 기대고 있지만, 실제 200차원 수준에서도 리콜 우세가 유지된다. 이는 무작위 회전과 좌표별 코드북 접근이 생각보다 넓은 차원 영역에서 실용적일 수 있음을 의미한다. 다만 고차원 이론이 가장 직접적으로 적용되는 영역은 여전히 1536차원과 3072차원 같은 대규모 임베딩이다.

Figure 6: OpenAI3 1536차원 임베딩에서의 Recall@1@k 비교. 고차원 임베딩 공간에서도 TurboQuant의 리콜 곡선은 경쟁 기법보다 우세하다.

1536차원 결과는 특히 오늘날 임베딩 검색 인프라와의 연관성이 높다. 많은 상용 임베딩 모델이 1536차원 또는 그 인근 차원을 사용하기 때문이다. 따라서 논문이 이 차원에서 높은 리콜과 극단적으로 빠른 양자화 시간을 함께 보여준 것은, TurboQuant가 실제 벡터 DB 시스템에 직접 도입될 가능성을 강하게 뒷받침한다. 이때 중요한 것은 단순한 리콜 우세만이 아니라, 인덱싱 시간 비용이 거의 무시 가능하다는 점이다.

Figure 7: OpenAI3 3072차원 임베딩에서의 Recall@1@k 비교. 차원이 더 커져도 TurboQuant의 검색 성능과 적용 속도 이점이 유지된다.

3072차원 결과는 고차원에서 TurboQuant의 설계 철학이 더욱 자연스럽게 작동함을 보여준다. 차원이 커질수록 무작위 회전 후 좌표가 거의 독립적으로 보인다는 가정은 더 정당화되며, 따라서 논문이 제시한 이론적 근거와 실험 결과의 연결도 더 강해진다. 이는 향후 더 큰 임베딩 차원이나 다중모달 토큰 공간에서도 비슷한 아이디어가 확장될 여지가 있음을 암시한다.

6.2 실무적 해석: 왜 이 결과가 중요한가

메모리를 줄이면서도 내적 구조를 유지하는 것이 실제 시스템 성능의 핵심이라는 점이 TurboQuant 실험 전반에서 반복적으로 확인된다. Needle-In-A-Haystack에서의 풀프리시전 동률, LongBench에서의 3.5비트 품질 중립, 검색에서의 높은 리콜과 극단적 속도는 모두 같은 메시지를 향한다. 즉 내적과 거리 구조를 잘 보존하는 압축은 LLM 회수와 생성, 벡터 검색 품질로 직접 이어진다.

특히 오늘날 긴 문맥 모델은 파라미터 양자화보다도 KV 캐시 압축이 더 중요한 문제가 되는 경우가 많다. 파라미터는 한 번 적재하면 되지만, KV 캐시는 시퀀스 길이에 따라 계속 늘어나기 때문이다. TurboQuant는 이 영역에서 "오프라인 학습 없이도 강한 압축과 품질 보존을 동시에 달성할 수 있다"는 하나의 설득력 있는 답을 제공한다. 또한 벡터 검색에서도 온라인 인덱싱 비용을 거의 무시할 수 있는 수준까지 줄인다는 점에서, LLM 인프라와 검색 인프라를 잇는 공통 압축 원리로도 읽힌다.

논문이 특히 가치 있는 이유는, 개선의 원인을 단순한 엔지니어링 트릭이 아니라 정보이론적 구조로 설명한다는 데 있다. 벤치마크 점수는 시간이 지나면 바뀔 수 있지만, $4^{-b}$ 왜곡률과 그 하한에 근접한다는 메시지는 오래 남는다. 이 점에서 TurboQuant는 단기적 SOTA 이상의 의미를 가진다. 향후 더 큰 컨텍스트, 더 큰 임베딩, 더 동적인 데이터 흐름이 등장할수록, 데이터에 의존하지 않으면서 거의 최적인 압축 방식의 중요성은 오히려 커질 가능성이 높다.

6.3 결과 해석의 세부 논점: 왜 TurboQuant가 LongBench와 검색 모두에서 통했는가

LongBench와 최근접 이웃 검색 결과를 함께 놓고 보면, TurboQuant의 장점은 단순한 압축기술 이상의 구조적 의미를 가진다. LongBench는 생성 품질이 중요하고, 최근접 이웃 검색은 순위 품질이 중요하다. 전자는 디코더가 긴 문맥의 정보를 종합해 다음 토큰을 생성하는 과정이고, 후자는 질의 벡터와 데이터 벡터 사이의 내적 순서를 유지하는 과정이다. 겉으로는 전혀 다른 문제처럼 보이지만, 둘 다 근본적으로는 고차원 벡터 간의 선형 관계에 민감하다. 논문은 바로 이 공통 기반을 겨냥한다. MSE를 최소화하는 것만으로는 이런 선형 관계 보존이 충분하지 않을 수 있으므로, 내적 추정을 명시적으로 설계 목표에 포함해야 한다는 논문의 문제 설정이 실험으로 그대로 정당화된다고 볼 수 있다.

예를 들어 LongBench의 SingleQA나 MultiQA는 긴 컨텍스트 안 여러 단서 중 무엇을 끌어와야 하는지가 중요하므로, 사실상 질의와 문맥 표현 사이의 어텐션 구조가 유지되어야 한다. 여기서 TurboQuant가 3.5비트에서 풀 캐시와 동등한 평균 점수를 보였다는 것은, 저비트 양자화 이후에도 핵심 토큰 간 점수 순위가 크게 무너지지 않았음을 의미한다. 이는 논문이 내적 보존에 특히 신경 쓴 이유와 일치한다. 반면 요약 과제에서 2.5비트 설정의 손실이 조금 더 크게 나타난 점은, 정보의 전체적 집계가 필요한 과제는 개별 회수보다 더 많은 누적 오차에 민감할 수 있음을 암시한다. 따라서 TurboQuant의 결과는 양자화가 모든 태스크에 동일한 영향을 주지 않으며, 어떤 태스크가 내적 미세오차에 더 민감한지까지 보여주는 자료로 읽을 수 있다.

최근접 이웃 검색 결과도 같은 맥락에서 해석할 수 있다. 검색 시스템은 대개 수백만 개 이상의 후보 벡터 중 상위 몇 개를 골라내야 한다. 이 과정에서 절대 점수보다 중요한 것은 상대 순위다. 내적이 조금씩만 뒤틀려도 top-k 집합이 달라질 수 있으며, 이때 Recall@1@k는 곧바로 떨어진다. TurboQuant가 PQ와 RabitQ 대비 더 높은 리콜을 유지했다는 것은 단순한 재구성 품질의 우위가 아니라, 질의와 후보 사이의 상대적 관계를 더 안정적으로 유지했음을 뜻한다. 특히 차원이 커질수록 이 우세가 유지되는 결과는 논문이 제시한 고차원 근사가 실제 검색 워크로드에서도 실효성을 가진다는 점을 잘 보여준다.

또 하나의 흥미로운 해석 포인트는 속도와 품질의 결합이다. 많은 압축 방법은 품질이 좋으면 느리고, 빠르면 품질이 떨어지는 경향이 있다. 그러나 TurboQuant는 사전 계산된 코드북과 무작위 회전이라는 간결한 구조 덕분에 양자화 시간이 거의 0에 가깝다. 검색 시스템에서는 인덱싱 시간과 질의 시간을 분리해서 생각하지만, 실제로는 새로운 문서가 들어올 때마다 빠르게 압축해 넣을 수 있어야 운영이 가능하다. 이때 TurboQuant의 장점은 단순한 오프라인 벤치마크 숫자 이상의 의미를 가진다. 좋은 리콜을 낸다는 사실만큼이나, 그 리콜을 얻기 위한 준비 시간이 사실상 무시 가능하다는 점이 중요하다.

논문이 data-oblivious라는 표현을 굳이 전면에 내세운 것도 같은 이유다. 오늘날 LLM 기반 애플리케이션은 정적인 모델 배포만 다루지 않는다. 사용자 로그, 외부 문서, 검색 인덱스, 장기 메모리, 에이전트 상태처럼 계속 추가되는 벡터를 다뤄야 한다. 만약 양자화기가 데이터셋 전체를 다시 보며 재학습해야 한다면, 그 자체로 시스템 운영이 어려워진다. TurboQuant는 회전 행렬과 코드북만 고정되면 새로운 벡터를 즉시 처리할 수 있으므로, 대규모 온라인 시스템과 더 잘 맞는다. 이 점은 논문이 장문맥 LLM과 벡터 검색을 하나의 문제군으로 바라보는 시각과도 연결된다.

6.4 방법론의 확장 가능성: KV 캐시를 넘어 어디까지 갈 수 있는가

TurboQuant의 구조는 특정 모델 아키텍처에 묶여 있지 않다는 점에서도 흥미롭다. 논문은 Llama-3.1-8B-Instruct와 Ministral-7B-Instruct를 실험에 사용했지만, 방법 자체는 트랜스포머의 특정 블록에 의존하지 않는다. 필요한 것은 고차원 벡터 표현과 그 위에서 중요한 연산이 MSE 혹은 내적 구조에 의해 잘 설명된다는 조건뿐이다. 이 때문에 TurboQuant는 KV 캐시뿐 아니라 활성값 캐시, retrieval memory bank, 멀티모달 임베딩 저장소, 심지어는 일부 분산 학습 환경의 통신 압축까지 확장될 여지가 있다. 논문은 직접적으로 모든 응용을 실험하지는 않았지만, 제시한 이론 구조 자체는 이처럼 훨씬 넓은 범위를 포괄할 수 있다.

특히 멀티모달 모델 관점에서 보면, 비전-언어 모델이나 음성-언어 모델 역시 내부적으로 대규모 임베딩과 내적 연산을 사용한다. 이러한 모델들은 일반 텍스트 LLM보다 입력 토큰 수가 훨씬 많아질 수 있고, 따라서 중간 표현 저장 비용도 빠르게 커진다. TurboQuant 같은 온라인 벡터 양자화기가 이런 환경에 적용된다면, 단순한 텍스트 컨텍스트 압축을 넘어 대규모 비전 토큰, 오디오 프레임 임베딩, 검색 인덱싱 메모리 등을 하나의 공통 원리로 압축할 수 있을 가능성이 있다. 즉 TurboQuant는 "KV 캐시 기법"이라기보다, 내적 중심 고차원 표현 시스템 전반을 위한 압축 원리에 가깝다.

물론 이런 확장을 위해서는 후속 검증이 필요하다. 예를 들어 멀티모달 표현은 텍스트 임베딩보다 더 비등방적일 수 있고, 일부 채널이 훨씬 강한 구조적 의미를 가질 수 있다. 논문이 LongBench 실험에서 아웃라이어 채널을 별도 취급한 것은 이러한 현실을 잘 보여준다. 따라서 이후 연구는 TurboQuant의 핵심 원리, 즉 무작위 회전과 코드북 기반 좌표 양자화를 유지하되, 레이어별·모달리티별 특성에 맞는 구조적 변형을 결합하는 방향으로 발전할 수 있다. 중요한 것은 그 변형이 데이터 의존적 학습의 복잡성을 다시 크게 불러오지 않도록 균형을 잡는 것이다.

또한 분산 추론 환경에서도 TurboQuant는 의미가 있다. 대형 모델을 여러 장비에 나눠 서빙할 때, 병목은 종종 연산 자체보다 장치 간 통신량에서 발생한다. 이 경우 중간 표현을 저왜곡으로 압축해 전달할 수 있다면, 메모리뿐 아니라 통신 대역폭도 줄일 수 있다. 내적 보존이 중요한 이유는 여기서도 마찬가지다. 전달된 표현이 후속 어텐션과 선형층에서 올바른 점수 구조를 유지해야 하기 때문이다. 논문은 이 시나리오를 직접 다루지 않지만, 정보이론적 하한에 근접하는 온라인 벡터 양자화기라는 정체성은 이러한 방향에도 자연스럽게 연결된다.

정리하면 추가 분석 섹션이 보여주는 것은 단순한 성능 수치 이상의 것이다. TurboQuant는 장문맥 생성, 검색, 온라인 인덱싱, 분산 시스템까지 이어질 수 있는 공통의 압축 패러다임을 제안한다. 그리고 그 패러다임의 중심에는 특정 데이터셋에 과적합된 엔지니어링이 아니라, 고차원 기하와 정보이론에 기반한 보편적 구조가 놓여 있다. 이 점이 바로 논문이 장기적으로도 읽힐 가치가 있는 이유다.

7. 한계점 및 향후 연구 방향: 무엇이 아직 남아 있는가

물론 TurboQuant가 모든 상황에서 완전한 해답은 아니다. 첫 번째 한계는 논문 자체가 상당 부분 고차원 근사에 기대고 있다는 점이다. 무작위 회전 후 좌표가 베타 분포를 따르고 거의 독립적으로 보인다는 설명은 차원이 커질수록 정당해진다. 실험상 200차원에서도 괜찮은 결과가 나왔지만, 매우 저차원이나 특이한 구조를 가진 데이터셋에서 같은 보장이 얼마나 잘 유지되는지는 추가 검증이 필요하다.

두 번째 한계는 논문이 제시한 최근접 이웃 검색 결과에서 정확한 리콜 수치 표를 모두 제공하지는 않는다는 점이다. Figure 곡선은 분명 TurboQuant가 우세하다는 메시지를 주지만, 실제 시스템 설계자가 threshold를 정하거나 특정 top-k 범위에서 비교하려면 더 세밀한 수치가 있으면 좋다. 후속 연구에서는 top-k별 정량 표, 메모리 대비 리콜 곡선, 실제 벡터 DB 통합 실험 등이 보강되면 실무적 설득력이 더 커질 것이다.

세 번째 한계는 TurboQuant가 무작위 회전 행렬과 잔차 QJL를 사용한다는 점에서, 완전한 결정론적 압축을 선호하는 환경에서는 추가 논의가 필요하다는 것이다. 물론 난수 시드를 고정하면 재현성 문제는 완화되지만, 대규모 분산 시스템에서 회전 행렬과 난수 상태를 어떻게 공유하고 저장할지, 또는 하드웨어 친화적으로 어떻게 구현할지는 별도의 엔지니어링 과제가 될 수 있다. 논문은 원리와 성능을 보여주지만, 산업 배포 수준의 커널 최적화까지는 다루지 않는다.

향후 연구 방향으로는 몇 가지가 자연스럽다. 첫째, TurboQuant를 혼합 정밀도 스케줄링과 결합해 레이어별·헤드별로 다른 회전/비트폭 정책을 탐색할 수 있다. 둘째, 현재는 MSE와 내적 두 목적이 분리된 형태인데, 실제 태스크 손실을 더 직접 반영하는 새로운 구조적 목적 함수로 일반화할 여지도 있다. 셋째, 벡터 DB나 RAG 시스템에서 삽입 즉시 인덱싱되는 온라인 환경을 대상으로 실제 운영 벤치마크를 수행하면 TurboQuant의 시스템적 가치가 더 분명해질 것이다. 넷째, 장문맥 LLM에서 레이어별 KV 캐시 중요도가 다르다는 점을 활용해 TurboQuant를 구조적 프루닝과 함께 조합하는 연구도 가능하다.

그럼에도 논문의 공헌은 분명하다. 한계는 대부분 "더 확장하면 좋은 부분"에 가깝고, 핵심 주장 자체를 흔드는 종류는 아니다. 오히려 이 논문은 앞으로의 양자화 연구가 단순히 몇 비트를 줄였는지보다, 어떤 연산 구조를 보존했고 그 구조가 정보이론적 하한과 얼마나 가까운지를 중심으로 재편될 가능성을 보여준다.

추가로 생각해볼 한계는 하드웨어 친화성의 세부 구현이다. 논문은 알고리즘 수준에서는 매우 빠른 양자화 시간을 보여주지만, 실제 가속기 커널 수준에서 회전 행렬 곱과 코드북 조회를 어떻게 최적으로 융합할 것인지는 남아 있다. 예를 들어 KV 캐시 압축에서는 양자화와 역양자화가 어텐션 경로 안에서 매우 자주 호출되므로, 단순한 파이썬 수준 구현과 커스텀 CUDA 커널 사이의 차이가 클 수 있다. 후속 연구에서 회전 연산을 구조화된 직교 행렬이나 빠른 Hadamard 계열 변환으로 대체해도 비슷한 이론 보장이 유지되는지 탐구한다면, TurboQuant의 배포 가능성은 더 높아질 것이다.

또 다른 방향은 레이어별 적응 정책이다. 모든 레이어의 KV 캐시가 동일한 민감도를 갖는 것은 아니다. 일부 레이어는 매우 거친 압축에도 견디지만, 다른 레이어는 작은 내적 왜곡에도 생성 품질이 민감하게 흔들릴 수 있다. 논문은 전체적으로 강력한 평균 결과를 보여주지만, 레이어별 민감도 분석까지는 제공하지 않는다. 만약 후속 연구가 TurboQuant의 회전-코드북 원리를 유지한 채 레이어별 혹은 헤드별 비트 예산 배분까지 학습 혹은 휴리스틱으로 조정한다면, 같은 메모리 예산에서 더 높은 품질을 얻을 가능성이 있다. 이는 특히 수백만 토큰 컨텍스트처럼 극단적인 장문맥 환경에서 중요해질 수 있다.

검색 시스템에서도 후속 과제는 분명하다. 현재 논문은 Recall@1@k와 양자화 시간에 초점을 맞추지만, 실제 벡터 DB에서는 메모리 사용량, 삽입 처리량, 삭제와 갱신 비용, 샤드 간 일관성 같은 운영 지표가 함께 중요하다. TurboQuant는 data-oblivious하다는 점에서 이러한 운영 시나리오에 유리할 가능성이 높지만, 실제 시스템 통합 벤치마크가 나오면 그 가치가 훨씬 더 명확해질 것이다. 특히 RAG 파이프라인처럼 문서 삽입과 검색이 동시에 일어나는 환경에서 TurboQuant가 기존 인덱싱 기법 대비 어떤 지연 분포를 보이는지는 매우 흥미로운 연구 주제다.

그럼에도 현재 단계에서 이 논문이 주는 메시지는 충분히 강하다. 벡터 양자화는 더 이상 단순한 저장 공간 절약 문제가 아니라, 대규모 AI 시스템의 계산 구조를 유지하면서 비용을 줄이는 문제로 이해되어야 한다. TurboQuant는 그 전환을 상징하는 논문이다. 이론적으로는 샤논 하한과 minimax 분석을 통해 최적성에 가까움을 설명하고, 실험적으로는 KV 캐시와 검색에서 모두 실용적 가치를 보였으며, 시스템적으로는 온라인 처리라는 명확한 장점을 제시한다. 후속 연구가 세부 구현을 어떻게 다듬든, 이 출발점의 중요성은 쉽게 사라지지 않을 것이다.

8. 결론: 온라인 적용성과 근최적 왜곡률을 동시에 달성한 보기 드문 설계

TurboQuant는 벡터 양자화를 다시 생각하게 만드는 논문이다. 저자들은 고차원 벡터를 무작위 회전시킨 뒤 좌표별 최적 스칼라 양자화를 적용하는 단순한 구조에서 출발해, MSE 왜곡과 내적 오차 모두에 대해 정보이론적 하한에 근접하는 강한 보장을 도출한다. 여기에 잔차 QJL를 더한 TurboQuantprod는 내적 추정의 무편향성까지 회복하며, 검색과 어텐션 중심 태스크에 맞는 목적지향 설계를 제공한다.

실험 결과는 이 이론이 공허하지 않음을 보여준다. Needle-In-A-Haystack에서는 풀프리시전과 동점, LongBench에서는 3.5비트에서 사실상 품질 중립, 최근접 이웃 검색에서는 높은 리콜과 압도적 양자화 속도를 동시에 달성했다. 특히 data-oblivious라는 특성 덕분에, TurboQuant는 학습 비용이 큰 오프라인 방법과 달리 실시간 시스템에 바로 통합될 잠재력이 높다.

개인적 감상을 덧붙일 필요 없이, 논문 자체가 이미 충분히 강한 메시지를 담고 있다. 좋은 양자화는 단순히 숫자를 줄이는 것이 아니라, 연산 구조를 보존하는 것이며, 그 구조를 보존하는 가장 설득력 있는 방법은 이론과 시스템 설계가 동시에 맞물리는 접근이라는 점이다. TurboQuant는 바로 그 사례다. 장문맥 LLM, 벡터 DB, RAG 인프라가 계속 커지는 현재 시점에서, 이 논문은 앞으로의 실용적 양자화 연구가 어디로 향해야 하는지를 비교적 선명하게 보여준다.

결론적으로 TurboQuant가 중요한 이유는, 양자화를 더 이상 모델 압축의 보조 기법으로 취급하지 않고 AI 시스템의 핵심 연산 구조를 보존하는 설계 문제로 재해석했기 때문이다. 많은 경우 메모리 절감은 곧바로 품질 손실과 교환되는 것으로 여겨지지만, 이 논문은 어떤 구조를 보존해야 하는지 정확히 짚어내면 그 교환비를 크게 개선할 수 있음을 보여준다. 특히 내적 중심 태스크에서 무편향성과 저왜곡률을 함께 추구한 점은 앞으로의 LLM 시스템 최적화 연구에서도 반복적으로 등장할 관점이다. 컨텍스트 길이가 더 길어지고, 모델이 더 많은 외부 메모리와 검색 시스템을 결합할수록, 이런 구조적 보존의 중요성은 더욱 커질 가능성이 높다.

또한 TurboQuant는 연구 방법론 측면에서도 교훈적이다. 이 논문은 복잡한 엔드투엔드 시스템 문제를 다루면서도, 이를 구성하는 수학적 핵심을 아주 명확한 형태로 추출한다. 무작위 회전, 좌표별 코드북, 잔차 QJL, 샤논 하한, minimax 분석이라는 다섯 요소는 각각 독립적인 것처럼 보이지만, 실제로는 하나의 일관된 서사를 이룬다. 좋은 압축 알고리즘은 데이터를 많이 본 알고리즘이 아니라, 데이터가 어떤 연산을 거쳐 사용되는지 정확히 이해한 알고리즘이라는 점을 이 논문은 잘 보여준다. 이런 점에서 TurboQuant는 단순히 한 편의 벤치마크 우승 논문이 아니라, 양자화 연구가 어떤 질문을 던져야 하는지를 다시 정리해주는 논문에 가깝다.

실무적으로도 메시지는 단순하다. 장문맥 LLM을 운영하거나, 대규모 벡터 검색 인프라를 설계하거나, 둘을 결합한 RAG 시스템을 구축하는 사람이라면, 메모리 비용과 품질 유지라는 두 목표를 동시에 만족하는 압축기를 원한다. TurboQuant는 바로 그 요구에 대해 현재 시점에서 가장 깔끔한 원리적 답변 중 하나를 제공한다. 물론 후속 연구가 커널 최적화, 레이어별 정책, 멀티모달 확장 같은 문제를 더 해결해야 하겠지만, 출발점은 이미 충분히 강하다. 논문은 온라인 적용성, 저비트 강건성, 이론적 근거, 실제 벤치마크 성능이라는 네 조건을 동시에 충족시키며, 앞으로 장문맥 AI 시스템의 기본 도구 상자에 들어갈 가능성이 높은 아이디어를 제시한다.

이 논문을 더 넓은 흐름 속에서 보면, 최근 AI 시스템 연구가 단순한 모델 스케일링에서 시스템 병목의 구조적 해소로 이동하고 있음을 잘 보여준다. 과거에는 파라미터 수를 늘리거나 학습 데이터를 확장하는 것이 중심이었다면, 이제는 메모리 이동, 캐시 보존, 검색 인덱싱, 통신 비용처럼 모델 바깥의 병목이 성능과 비용을 함께 결정한다. TurboQuant는 바로 이 전환점에서 등장한 논문이다. 무엇을 압축하느냐보다, 압축된 표현이 이후 연산에서 어떤 역할을 하는지를 먼저 본다는 점에서, 이 논문은 시스템 최적화와 표현학습 사이의 간극을 메우는 성격을 가진다. 그런 의미에서 TurboQuant는 단순한 양자화 알고리즘이 아니라, 대규모 AI 인프라를 설계하는 관점을 정리해주는 작업이라 할 수 있다.

마지막으로 이 논문은 실무와 이론이 반드시 대립하지 않는다는 사실을 잘 보여준다. 강한 수학적 보장을 가진 방법은 종종 느리고 복잡하다고 여겨지지만, TurboQuant는 오히려 이론 덕분에 구조가 단순해졌다. 고차원에서의 분포 성질을 이해했기 때문에 좌표별 코드북이라는 구현적으로 쉬운 방식이 가능해졌고, 내적 편향을 명시적으로 분석했기 때문에 잔차 QJL 같은 간결한 보정 경로가 도출되었다. 즉 이론이 구현을 방해한 것이 아니라, 구현을 더 명확하게 만들었다. 이런 점에서 TurboQuant는 앞으로의 시스템형 ML 연구가 지향할 하나의 좋은 모범 사례로도 읽힌다.

한편 논문이 보여준 성과는 단순히 더 좋은 숫자를 냈다는 의미만은 아니다. 중요한 것은 품질 보존의 설명 가능성이다. 왜 어떤 비트폭에서 성능이 유지되고, 왜 어떤 상황에서 손실이 늘어나는지를 이론과 실험이 함께 설명해준다. LongBench에서 요약 과제가 상대적으로 더 민감하게 반응한 점, TurboQuantmse가 저비트에서 편향을 보인 점, TurboQuantprod가 검색과 회수에 특히 강한 점은 모두 동일한 구조적 논리로 연결된다. 이런 설명 가능성은 실무자가 압축 정책을 선택할 때 매우 중요하다. 단순히 평균 점수만 높은 방법보다, 어느 상황에서 어떤 식으로 실패하는지까지 예측 가능한 방법이 운영 측면에서는 훨씬 신뢰할 만하기 때문이다.

이 결과는 후속 연구가 더 공격적인 커널 최적화, 더 정교한 레이어별 정책, 더 넓은 멀티모달 적용 범위를 검토할 기준점을 제공한다. 그러나 그 모든 확장의 기준은 여전히 같다. 압축 이후에도 핵심 연산 구조가 유지되는가, 그리고 그 유지 정도가 문제의 정보이론적 한계와 얼마나 가까운가 하는 질문이다. TurboQuant는 이 질문을 명시적으로 제기하고 현재 실험 범위 안에서 강한 결과를 제시한다.

종합하면 TurboQuant는 "더 적은 비트로도 충분히 유지될 수 있는 것은 무엇인가"라는 질문에 대해 가장 정면으로 답한 작업 중 하나다. 답은 모든 좌표값을 완벽히 복원하는 것이 아니라, 고차원 표현이 이후 연산에서 수행하는 역할을 보존하는 것이다. 이 논문이 MSE와 내적 오차를 분리해서 다루고, 그 차이를 이론과 실험 양쪽에서 설득력 있게 입증한 이유도 여기에 있다. 결국 대규모 AI 시스템에서 중요한 것은 압축 자체가 아니라, 압축 이후에도 모델과 검색 시스템이 이전과 거의 같은 방식으로 사고하고 선택할 수 있느냐이다. TurboQuant는 현재까지 알려진 방법 중 그 목표에 가장 우아하게 접근한 사례로 평가할 수 있다.

무작위 회전, 좌표별 코드북, 잔차 보정이라는 세 요소는 각각 익숙한 아이디어일 수 있지만, 이 논문은 그것들을 하나의 일관된 압축 철학으로 묶었다. 바로 그 점이 TurboQuant를 단순한 조합형 기법이 아니라 새로운 기준점으로 만든다. 향후 누가 더 나은 압축기를 제안하더라도, 이제는 TurboQuant가 던진 질문들, 즉 온라인성, 구조 보존, 하한 근접성이라는 세 기준을 함께 넘어야 설득력을 얻기 쉬울 것이다.

그만큼 이 논문은 단기적 성능 경쟁을 넘어, 앞으로의 압축 연구가 어떤 질문을 우선순위에 두어야 하는지까지 정리해준다는 점에서 의미가 크다.

이 점만으로도 TurboQuant는 2025년 양자화 연구에서 반드시 짚고 넘어가야 할 기준 논문으로 남을 가능성이 높다.

정말 매우 중요하다.

9. 요약 정리

- TurboQuant는 무작위 회전으로 입력 벡터를 구면 분포에 가깝게 바꾸고, 각 좌표에 대해 최적 스칼라 양자화를 적용하는 온라인 벡터 양자화기다.

- TurboQuantmse는 재구성 MSE를 최소화하며, 왜곡률이 $4^{-b}$ 꼴의 정보이론적 최적 속도에 상수배 차이로 근접한다.

- TurboQuantprod는 $(b-1)$비트 MSE 양자화와 잔차 1비트 QJL를 결합해 내적 추정의 무편향성을 달성한다.

- 논문은 샤논 하한과 Yao의 minimax 원리를 사용해, 어떤 양자화기도 넘기 어려운 하한을 제시하고 TurboQuant가 그 근처에 있음을 보인다.

- Needle-In-A-Haystack에서 TurboQuant는 0.997 점수로 풀프리시전과 완전히 동일한 결과를 기록했다.

- LongBench에서 Llama-3.1-8B-Instruct 기준 3.5비트 TurboQuant는 평균 50.06으로 풀 캐시와 동일한 점수를 보였다.

- 2.5비트 TurboQuant도 평균 49.44로 경쟁력을 유지하며, 메모리 절감 대비 품질 손실이 작다.

- 최근접 이웃 검색에서 TurboQuant는 PQ와 RabitQ보다 높은 리콜을 보이며, 양자화 시간은 d=3072에서도 0.0021초 수준으로 사실상 즉시 적용 가능하다.

- 이 논문의 핵심 메시지는 압축률 자체보다 내적과 거리 구조 보존이 실제 시스템 품질의 중심이라는 점이며, TurboQuant는 그 원리를 이론과 실험으로 함께 보여준다.